IT女子 アラ美

IT女子 アラ美お疲れ様です!IT業界で働くアライグマです!

「NotebookLMは便利だけど、機密情報をクラウドに送りたくない」「ローカルLLMでNotebookLMのような機能を実現できないか」「OpenAIやAnthropicのAPIコストを抑えながらAIノートブックを使いたい」。こうした悩みを抱えているエンジニアは少なくありません。

実際の開発現場でも、機密情報を含むドキュメントをクラウドAPIに送信することへの懸念は根強い問題です。本記事では、NotebookLMのオープンソース版であるOpen Notebookを、Ollamaと組み合わせて完全ローカル環境で構築する方法を解説します。

Open NotebookとNotebookLMの違いを理解する

Windows環境で安定してOllama・Open Notebookを回すならXServer クラウドPCが最適よ

いつでもどこでもクラウド上PCにアクセス!仮想デスクトップサービス【XServer クラウドPC】

Open Notebookは、Google NotebookLMのオープンソース版として開発されたツールです。ドキュメントをアップロードしてAIと対話しながら情報を整理・分析できるという基本コンセプトはNotebookLMと同じですが、いくつかの重要な違いがあります。

NotebookLMの特徴と制約

NotebookLMはGoogleが提供するAIノートブックサービスで、PDFやGoogle Docsなどのドキュメントをアップロードすると、AIがその内容を理解して質問に答えてくれます。Audio Overview機能でドキュメントの内容をポッドキャスト形式で聴けるなど、ユニークな機能も備えています。

しかし、NotebookLMには以下のような制約があります。

- データがGoogleのサーバーに送信される:機密情報を含むドキュメントの取り扱いに懸念がある

- オフライン環境では使用できない:インターネット接続が必須

- カスタマイズ性が限られる:使用するモデルや処理方法を変更できない

Open Notebookのメリット

Open Notebookは、これらの制約を解消するために開発されました。

- 完全ローカル実行:データが外部に送信されないため、機密情報を安全に扱える

- モデルの選択が自由:Ollamaを通じて様々なLLMを使用可能

- コスト削減:クラウドAPIの従量課金を気にせず使い放題

- オフライン対応:インターネット接続なしでも動作する

開発現場では、社内の技術ドキュメントや議事録を分析する際にOpen Notebookを活用するケースが増えています。クラウドAPIを使わないため、情報セキュリティ部門との調整もスムーズに進む傾向があります。

ローカルLLMの活用に興味がある方は、Cursor×Ollamaで実現するローカルAI開発環境:コスト削減と高速化を両立する実践構成ガイドも参考にしてください。

ケーススタディ:クラウドAIノートブック依存から脱却した事例

ここでは、Open Notebookの導入で実際に課題を解決した事例を紹介します。

田中さん(仮名・32歳・インフラエンジニア・経験7年)のケース

田中さんは、金融系SIerのインフラチームで社内ナレッジの整備を担当していました。チーム内の障害対応報告書や設計書が属人化しており、「過去に同じ障害が起きていたはずだが、誰に聞けばいいかわからない」という問題が慢性化していました。

導入前の状況。ナレッジ検索に1件あたり平均45分かかっており、月間の障害対応件数約20件のうち、過去事例の参照に成功するのは3割程度でした。NotebookLMの利用を提案しましたが、金融系の厳格なセキュリティポリシーにより、社内ドキュメントの外部送信は一切禁止されていたため、導入は却下されました。

Open Notebook導入の経緯。田中さんはOllamaとOpen Notebookの組み合わせを検証し、すべてのデータ処理がローカルで完結する構成であることをセキュリティ部門に説明しました。ネットワーク監視ツールで外部通信が発生しないことを実証したうえで、チーム内のトライアル導入が承認されました。

導入後の成果は明確でした。

- ナレッジ検索時間:1件あたり平均45分→8分に82%短縮

- 過去事例の参照成功率:30%→85%に改善

- 月間のAPI費用:クラウドAPI利用時の想定月額5万円→0円(完全ローカル)

田中さんは振り返ります。「セキュリティ要件が厳しい環境でも、ローカル完結型なら導入のハードルを大きく下げられる。最初は7Bモデルで精度に不安がありましたが、RAG(検索拡張生成)の仕組みのおかげで、ドキュメントの内容に基づいた回答は十分実用的でした。もっと早くOpen Notebookの存在を知っていれば、セキュリティ部門との交渉に半年も費やさずに済んだはずです」。

RAGシステムの精度向上に興味がある方は、RAGシステムのチューニング手法:検索精度と回答品質を向上させる実践的アプローチも参考にしてください。

Open Notebookのローカル環境構築に必要な前提条件

Open Notebookをローカル環境で動作させるためには、いくつかの前提条件を満たす必要があります。ここでは、ハードウェア要件とソフトウェア要件を整理します。

ハードウェア要件

Open Notebookをローカルで快適に動作させるためには、以下のスペックを推奨します。

- メモリ:16GB以上(32GB推奨)

- ストレージ:SSD 50GB以上の空き容量

- GPU:NVIDIA GPU(VRAM 8GB以上)があると高速化できるが、CPUのみでも動作可能

実務では、NVIDIA RTX 3060(12GB VRAM)クラスのGPUで運用しているケースが多く、7Bパラメータのモデルであれば快適に動作します。

ソフトウェア要件

以下のソフトウェアが必要です。

- Docker:コンテナ環境でOpen Notebookを実行

- Ollama:ローカルLLMの実行環境

- Git:リポジトリのクローン用

Ollamaのインストール

まず、Ollamaをインストールします。Linuxの場合は以下のコマンドで簡単にインストールできます。

curl -fsSL https://ollama.com/install.sh | shmacOSの場合は、公式サイトからインストーラーをダウンロードするか、Homebrewを使用します。

brew install ollamaインストール後、Ollamaサービスを起動します。

ollama serveDockerを使った開発環境の構築については、WSL2開発環境の最適化:パフォーマンスとセキュリティを両立する設定ガイドも参考にしてください。

Open Notebookのインストールと初期設定

前提条件が整ったら、Open Notebookをインストールします。ここでは、Dockerを使った構築方法とOllamaとの連携設定を説明します。

リポジトリのクローン

まず、Open Notebookのリポジトリをクローンします。

git clone https://github.com/open-notebook/open-notebook.git

cd open-notebook環境変数の設定

Open NotebookをOllamaと連携させるために、環境変数を設定します。.envファイルを作成し、以下の内容を記述します。

# LLMプロバイダーの設定

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

# 使用するモデル

LLM_MODEL=llama3.2

EMBEDDING_MODEL=mxbai-embed-largeLLM_MODELには、Ollamaで利用可能なモデルを指定します。日本語対応が必要な場合は、日本語に強いモデルを選択してください。

Dockerコンテナの起動

環境変数の設定が完了したら、Dockerコンテナを起動します。

docker compose up -d起動が完了すると、http://localhost:3000でOpen Notebookにアクセスできます。

Ollamaモデルのダウンロード

Open Notebookで使用するモデルを事前にダウンロードしておきます。

# LLMモデルのダウンロード

ollama pull llama3.2

# Embeddingモデルのダウンロード

ollama pull mxbai-embed-large実務ではllama3.2(8B)を使用するケースが多いです。より高精度な回答が必要な場合は、70Bクラスのモデルを検討してください。

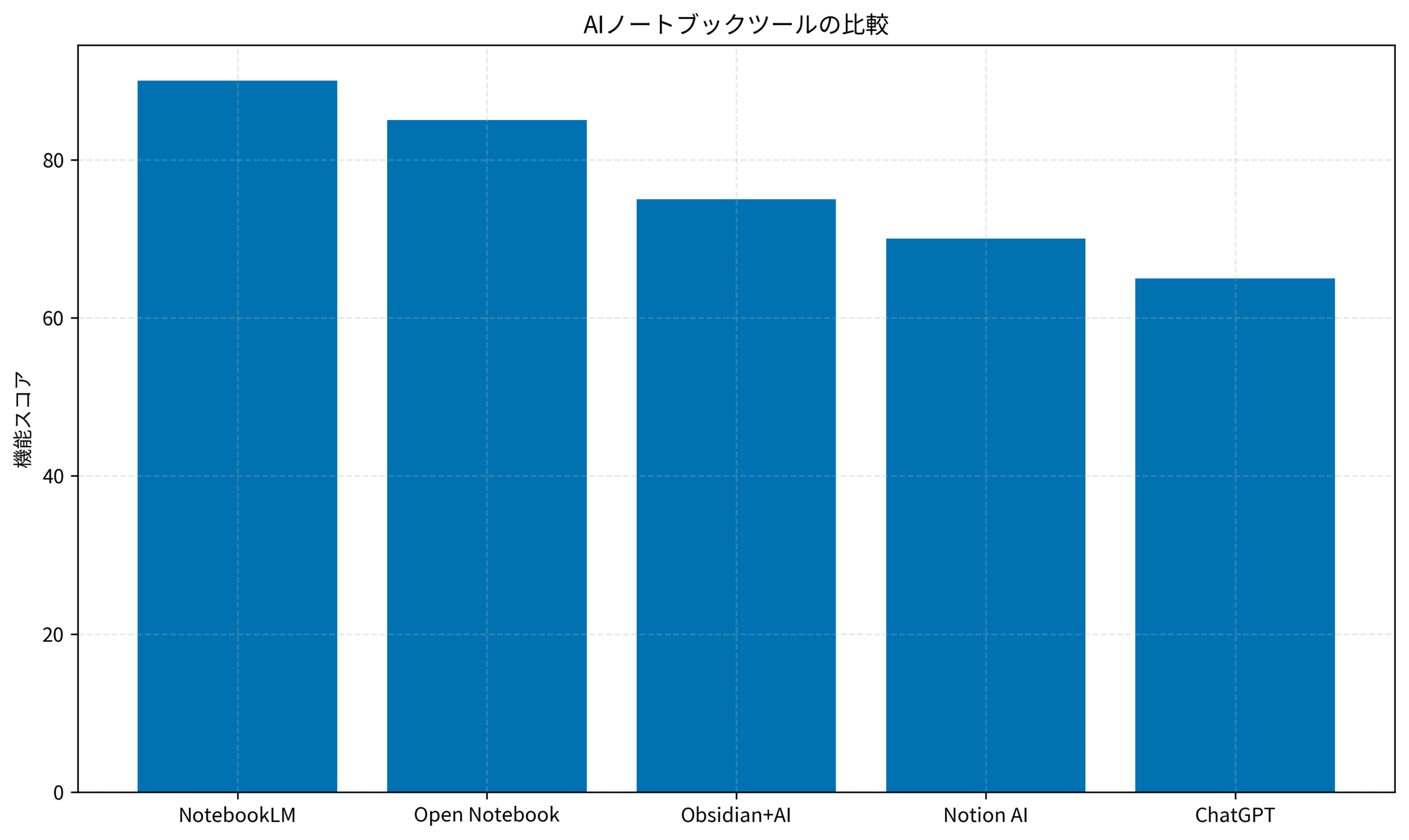

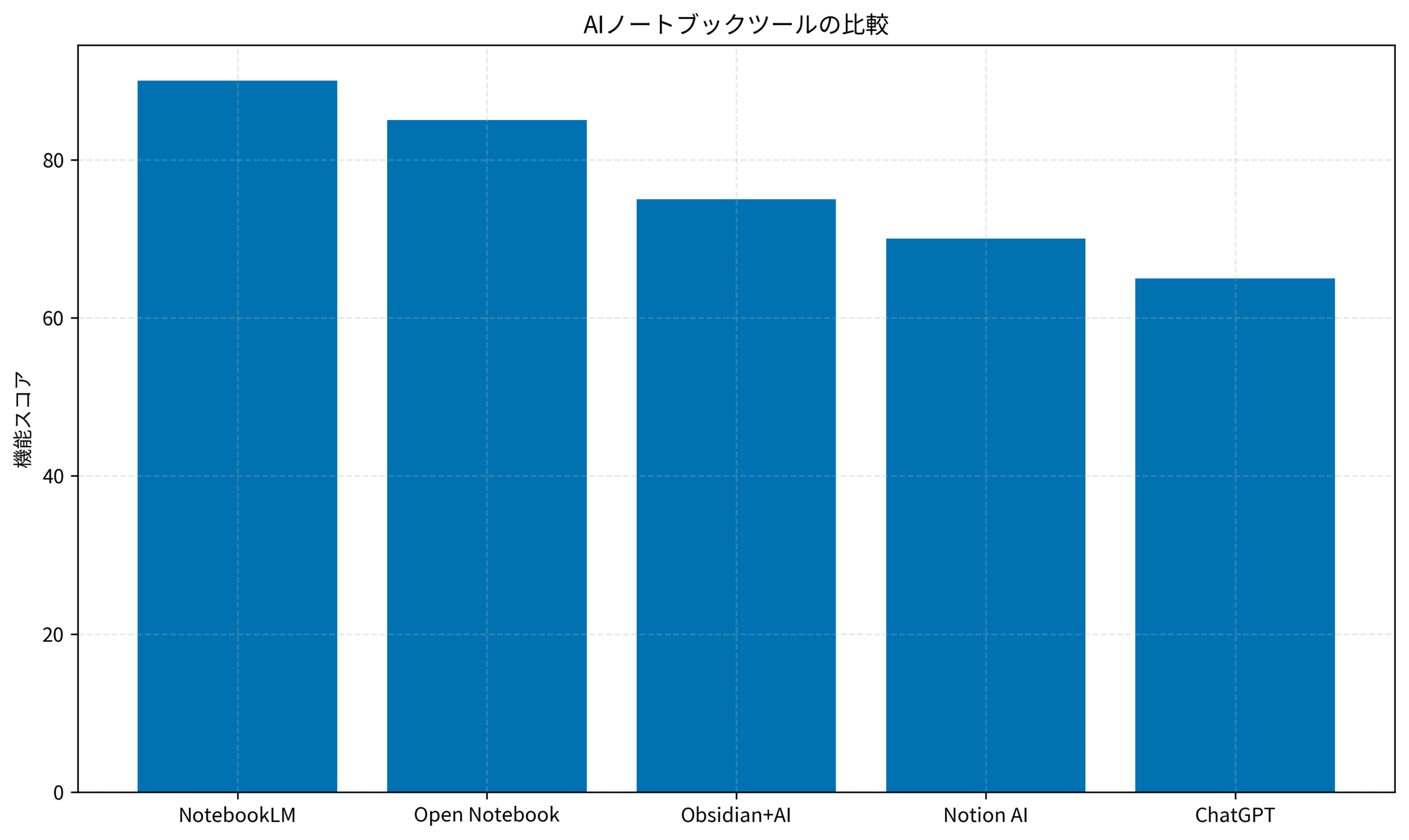

以下のグラフは、AIノートブックツールの機能を比較したものです。NotebookLMが最も高機能ですが、Open Notebookはローカル実行という大きなメリットがあり、機密情報を扱う場面では最適な選択肢となります。

LangChainを使ったAIアプリケーション開発については、FastAPI×LangChainで構築するAIバックエンド:実践的な設計パターンとプロダクション運用も参考にしてください。

Open Notebookを使ったドキュメント分析ワークフロー

Open Notebookの環境が整ったら、実際にドキュメントを分析してみましょう。ここでは、ドキュメントのアップロードから質問応答までの基本的なワークフローを紹介します。

ドキュメントのアップロード

Open Notebookのダッシュボードにアクセスし、分析したいドキュメントをアップロードします。対応しているファイル形式は以下の通りです。

- PDF:技術ドキュメント、論文、マニュアルなど

- テキストファイル:Markdown、プレーンテキスト

- Webページ:URLを指定してコンテンツを取得

ドキュメントの分析と質問

ドキュメントがアップロードされると、Open Notebookは自動的にテキストを抽出し、Embeddingモデルでベクトル化します。その後、チャットインターフェースで質問を入力すると、関連する箇所を参照しながら回答を生成します。

実務で活用されている代表的なユースケースを紹介します。

- 技術仕様書の要約:「このドキュメントの主要な技術要件を箇条書きでまとめて」

- 議事録からのアクションアイテム抽出:「この議事録から決定事項とTODOを抽出して」

- 複数ドキュメントの横断検索:「セキュリティに関する記述をすべてのドキュメントから集めて」

ノートの作成と整理

Open Notebookでは、AIとの対話結果をノートとして保存できます。これにより、後から参照したり、チームメンバーと共有したりすることが可能です。

MCPを使ったAI連携については、MCPサーバー開発ガイド:AIエージェントと外部システムを連携させる実装パターンも参考にしてください。こうしたAIツールのスキルを副業収入に繋げたい方は、エンジニア副業の収入ロードマップも合わせてご覧ください。

ローカルAI環境の構築スキルを活かしてフリーランスとして独立を目指す方はフリーランスエンジニア向けエージェント5社比較、年収アップを目指すならハイクラスエンジニア転職エージェント3社比較も参考にしてください。30歳前後でキャリアの分岐点に立っている方は30歳エンジニアのキャリア分岐点ガイドも合わせてどうぞ。

Open Notebookの運用最適化とトラブルシューティング

Open Notebookを本格的に運用するためには、パフォーマンスの最適化とよくあるトラブルへの対処法を知っておく必要があります。

パフォーマンス最適化のポイント

ローカル環境でのLLM実行は、クラウドAPIと比べて応答速度が遅くなりがちです。以下のポイントを意識することで、パフォーマンスを改善できます。

- GPUの活用:NVIDIA GPUがある場合は、CUDAを有効にしてOllamaを実行する

- モデルサイズの選択:用途に応じて7B〜70Bのモデルを使い分ける

- コンテキスト長の調整:長いドキュメントを扱う場合は、チャンクサイズを最適化する

よくあるトラブルと対処法

Open Notebookの運用で遭遇しやすいトラブルと、その解決方法を共有します。

- Ollamaに接続できない:Docker内からOllamaに接続できない場合は、

OLLAMA_BASE_URLの設定を確認してください。Dockerの場合はhost.docker.internalを使用します - メモリ不足でモデルが起動しない:大きなモデルを使用する場合、メモリ不足で起動に失敗することがあります。その場合は、より小さなモデル(7B程度)に切り替えるか、メモリを増設してください

- 日本語の回答精度が低い:英語ベースのモデルでは日本語の回答精度が低くなることがあります。日本語に対応したモデルを使用することで改善できます

日本語環境での最適化

Open Notebookを日本語ドキュメントで活用する場合、モデル選択が回答品質を大きく左右します。

- llama3.2:多言語対応で日本語も実用レベル。最初の選択肢として安定

- Qwen2.5:中国語・日本語を含むアジア言語に強い。技術ドキュメントの分析に好適

- gemma2:軽量で日本語の自然さに優れる。メモリが限られる環境向き

日本語対応モデルに切り替えるには、.envのLLM_MODELを変更するだけです。

# 日本語に強いモデルに変更

LLM_MODEL=qwen2.5

# モデルをダウンロード

ollama pull qwen2.5Embeddingモデルも日本語対応のものに変更すると、ドキュメント検索の精度がさらに向上します。

セキュリティ上の注意点

Open Notebookはローカルで動作しますが、ネットワーク設定には注意が必要です。

- 外部からのアクセス制限:ファイアウォールでポート3000へのアクセスを制限する

- 認証の設定:チームで共有する場合は、認証機能を有効にする

- ログの管理:機密情報がログに残らないよう設定を確認する

よくある質問

Q. Open Notebookの利用にGPUは必須ですか?

いいえ、GPUは必須ではありません。CPUのみでも動作しますが、応答速度が遅くなります。7Bパラメータのモデルであれば、16GBのメモリがあればCPUのみでも実用的な速度で動作します。より快適に使いたい場合は、NVIDIA GPU(VRAM 8GB以上)の導入を検討してください。

Q. NotebookLMからOpen Notebookに移行するメリットは何ですか?

最大のメリットはデータのプライバシー保護です。Open Notebookではすべての処理がローカルで完結するため、機密情報を含むドキュメントも安心して分析できます。また、クラウドAPIの従量課金が不要になるため、ランニングコストを大幅に削減できます。一方で、Audio Overview機能など、NotebookLM固有の機能は利用できない点には注意が必要です。

Q. どのOllamaモデルがOpen Notebookに適していますか?

日本語ドキュメントの分析には、日本語対応のモデルが推奨されます。llama3.2は多言語対応で汎用性が高く、最初の選択肢として適しています。メモリに余裕がある場合は、70Bクラスのモデルを使うことで回答の精度が向上します。Embeddingモデルはmxbai-embed-largeが安定した性能を発揮します。

Q. 複数人でOpen Notebookを共有できますか?

はい、同一ネットワーク内の他のマシンからもブラウザ経由でアクセスできます。ただし、認証機能がデフォルトでは無効のため、チームで利用する場合はリバースプロキシ(Nginxなど)を挟んで認証を追加することを推奨します。外部からのアクセスにはファイアウォール設定も確認してください。

Q. セットアップにかかる目安の時間は?

OllamaとDockerが既にインストール済みの環境であれば、リポジトリのクローンからDockerコンテナ起動までは約10〜15分で完了します。初回のみOllamaモデル(llama3.2で約2GB、70Bクラスで約40GB)のダウンロードが入るため、回線速度によってはさらに10〜30分ほどかかることがあります。まずは7Bクラスのモデルで動作確認し、問題なければ大きいモデルに切り替える流れがスムーズです。

Q. Open NotebookとLM Studio・Jan・AnythingLLMとの違いは?

Open NotebookはNotebookLMのワークフロー(ソース登録→質問→ノート化)を忠実に再現することに特化しています。LM StudioやJanは汎用的なローカルLLMのチャットUIに近く、ドキュメント分析特化ではありません。AnythingLLMはドキュメント分析寄りですが、UIの思想がより企業ナレッジベース向けです。「NotebookLMの代替として使いたい」ならOpen Notebookが最も近い選択肢になります。

AI学習の方向性に迷っている場合は、以下の比較表で自分に合ったサービスを確認してみてください。ローカルAI環境の構築先として開発用サーバーを検討中の方はエンジニア向けXServer用途別比較ガイド、チームでの生成AI展開を進めるPjMはPjM向け業務効率化SaaS比較も参考になります。

本記事で解説したようなAI技術を、基礎から体系的に身につけたい方は、以下のスクールも検討してみてください。

| 比較項目 | Winスクール | Aidemy Premium |

|---|---|---|

| 目的・ゴール | 資格取得・スキルアップ初心者〜社会人向け | エンジニア転身・E資格Python/AI開発 |

| 難易度 | 個人レッスン形式 | コード記述あり |

| 補助金・給付金 | 教育訓練給付金対象 | 教育訓練給付金対象 |

| おすすめ度 | 幅広くITスキルを学ぶなら | AIエンジニアになるなら |

| 公式サイト | 詳細を見る | − |

まとめ

Open Notebookは、NotebookLMのオープンソース版として、ローカル環境でAIノートブック機能を実現できる強力なツールです。

- Open Notebookの特徴:完全ローカル実行、モデル選択の自由、コスト削減、オフライン対応

- 環境構築:Docker + Ollamaの組み合わせで簡単にセットアップ可能

- 活用方法:ドキュメントのアップロード、質問応答、ノート作成

- 運用のコツ:GPU活用、モデルサイズの選択、セキュリティ設定

機密情報を含むドキュメントを安全に分析したい場合や、クラウドAPIのコストを抑えたい場合には、Open Notebookは最適な選択肢です。まずは小さなドキュメントから試してみて、自分のワークフローに合った使い方を見つけてください。

ローカルAI環境の構築は、エンジニアとしてのスキルアップにもつながる取り組みです。ぜひ本記事を参考に、Open Notebookを活用したドキュメント分析ワークフローを構築してみてください。