IT女子 アラ美

IT女子 アラ美お疲れ様です!IT業界で働くアライグマです!

「複数のLLMを同時に使いたいけど、切り替えが面倒」「どのLLMが自分のタスクに最適か、実際に試して判断したい」。こんな悩みを抱えているエンジニアの方は多いのではないでしょうか。

oh-my-opencodeを使えば、Claude・GPT・Geminiを統一インターフェースで同時に操作でき、それぞれの強みを活かした「マルチLLM開発環境」を構築できます。導入から実践的な活用方法まで、具体的なコード例とともに解説します。

oh-my-opencodeとは何か:マルチLLM統合ツールの概要

AI活用リードとして年収アップを狙うなら社内SE特化エージェントに相談しなさい

社内SEを目指す方必見!IT・Webエンジニアの転職なら【社内SE転職ナビ】

oh-my-opencodeは、複数のLLM(Claude、GPT、Gemini、Llama等)を統一されたCLIインターフェースで操作できるOSSツールです。

主な特徴

- 統一CLI:同じコマンド体系で異なるLLMを操作可能

- 並列実行:複数のLLMに同時にプロンプトを送り、結果を比較

- プロファイル管理:タスク別に最適なLLM設定をプリセットとして保存

- コスト追跡:各LLMのAPI使用量とコストをリアルタイム表示

- ローカルLLM対応:Ollamaを介してローカルモデルも統合可能

なぜマルチLLMが必要なのか

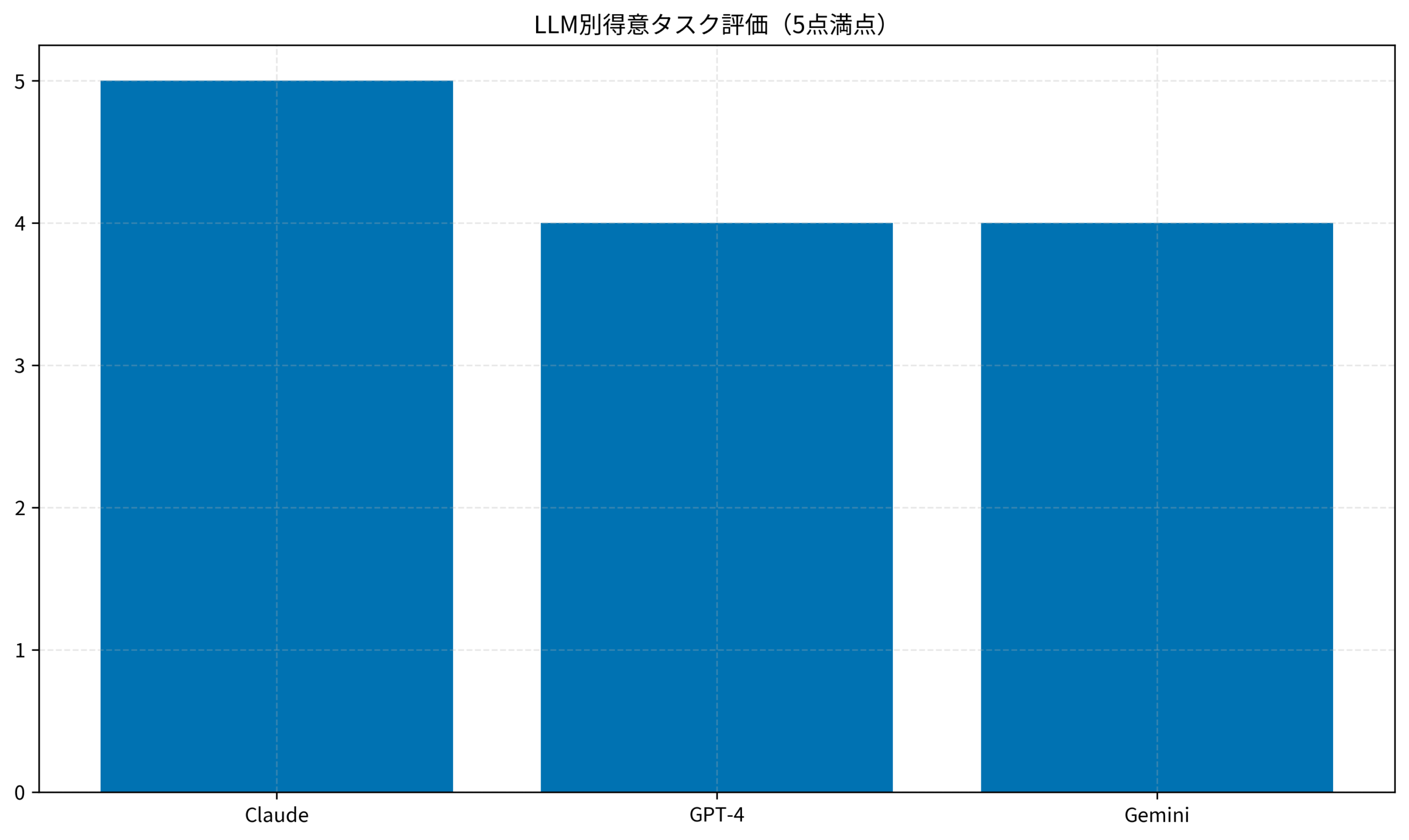

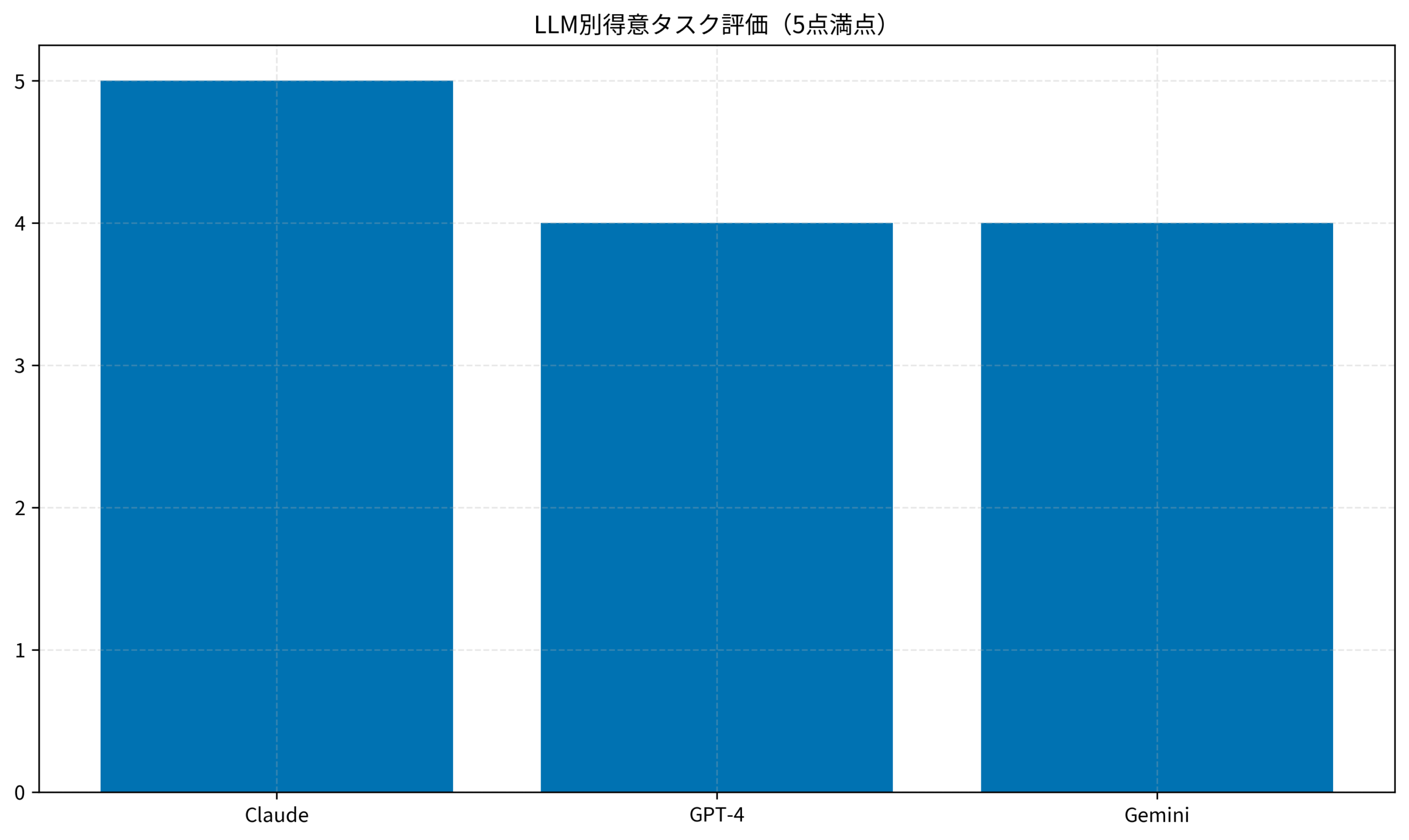

各LLMには明確な得意・不得意があります。

- Claude:長文のコンテキスト理解、コード生成、論理的な分析

- GPT-4:創造的なタスク、多言語対応、幅広い知識

- Gemini:マルチモーダル(画像・動画)、Googleサービス連携

単一のLLMに依存するよりも、タスクに応じて使い分けることで、精度と効率が大幅に向上します。

主要LLMの得意分野・コスト比較表

oh-my-opencodeで扱える主要LLMの得意分野とコスト感を整理します。タスクごとに使い分けることで、品質維持しつつコストを最適化できます。

| LLM | 得意分野 | コスト(入力1Mトークン目安) | 推奨タスク |

|---|---|---|---|

| Claude Opus 4.7 | 長文理解・複雑推論・コード生成 | $15 | 設計判断・リファクタ・レビュー |

| Claude Sonnet 4.6 | バランス型・実装タスク | $3 | 日常コーディング・要約 |

| GPT-4o | 多言語・創造的タスク | $2.5 | 翻訳・コピーライティング |

| GPT-5 | 論理推論・数値計算 | $10 | アルゴリズム設計・計算検証 |

| Gemini 2.5 Pro | マルチモーダル・Google連携 | $1.25 | 画像解析・YouTube要約 |

| Llama 3.3(ローカル) | プライバシー要件・コスト最小化 | 電気代のみ | 機密コード処理・常時実行 |

開発環境でのAI活用については、Cursor でローカルLLMを使うセットアップガイドも参考になります。

oh-my-opencodeのインストールと初期設定

ここでは、oh-my-opencodeのインストールから各LLMのAPI設定までを解説します。

前提条件

- Node.js 18.0以上

- 各LLMのAPIキー(Claude、OpenAI、Google AI Studio)

- (オプション)Ollama(ローカルLLM用)

インストール手順

# npmでグローバルインストール

npm install -g oh-my-opencode

# バージョン確認

omc --version

# 出力例: oh-my-opencode v1.2.3APIキーの設定

各LLMのAPIキーを環境変数で設定します。

# .bashrc または .zshrc に追加

export ANTHROPIC_API_KEY="sk-ant-..."

export OPENAI_API_KEY="sk-..."

export GOOGLE_AI_API_KEY="AIza..."

# 設定を反映

source ~/.bashrc設定ファイルの作成

設定ファイル(~/.omc/config.yaml)に記述します。

providers:

claude:

model: claude-sonnet-4-20250514

max_tokens: 4096

openai:

model: gpt-4o

max_tokens: 4096

gemini:

model: gemini-2.5-flash

max_tokens: 4096

defaults:

provider: claude

parallel: false

profiles:

code-review:

provider: claude

temperature: 0.2

creative:

provider: openai

temperature: 0.8

analysis:

provider: gemini

temperature: 0.3AIツールの設定管理については、Claude Codeのコンテキストモニタリングも参考になります。

マルチLLM並列実行の実践

ここでは、実際に複数のLLMを並列実行して結果を比較する方法を解説します。

基本的なコマンド

# 単一LLMで実行

omc ask "このコードをリファクタリングしてください" --provider claude

# 複数LLMで並列実行

omc ask "このコードをリファクタリングしてください" --parallel claude,openai,gemini

# 結果をmarkdownで出力

omc ask "APIの設計レビューをしてください" --parallel claude,openai --format markdownパイプラインによる連携

あるLLMの出力を別のLLMに渡すパイプライン処理も可能です。

# Claudeでコード生成→GPTでドキュメント生成→Geminiで翻訳

omc pipe \

--step "claude:このAPIの実装コードを生成" \

--step "openai:このコードのREADMEを作成" \

--step "gemini:このREADMEを日本語に翻訳"プロファイルの活用

設定ファイルで定義したプロファイルを使って、タスクに最適化された設定で実行できます。

# コードレビュー用プロファイルで実行(temperature低め)

omc ask "このPRをレビューしてください" --profile code-review

# クリエイティブ用プロファイルで実行(temperature高め)

omc ask "このアプリのキャッチコピーを考えて" --profile creativeLLMの使い分けについては、複数AIで合意形成するLLM Councilの考え方も参考になります。

ケーススタディ:コードレビュー自動化の実装

高橋さん(仮名・31歳・バックエンドエンジニア・経験7年)のチームでoh-my-opencodeを使ったコードレビュー自動化の事例を紹介します。

状況(Before)

高橋さんのチームでは、プルリクエストのレビューに以下の課題がありました。

- レビュー待ち時間:平均2日(レビュアーのスケジュール依存)

- レビュー品質のばらつき:レビュアーによって指摘ポイントが異なる

- セキュリティチェック漏れ:手動レビューでは見落としが発生

行動(Action)

oh-my-opencodeを使って、以下のレビューパイプラインを導入しました。

#!/bin/bash

# review-pipeline.sh

PR_DIFF=$(gh pr diff $1)

# 並列レビュー実行

omc ask "このdiffをレビューしてください: $PR_DIFF" \

--parallel claude,openai \

--format json \

--output review_results.json

# 結果をマージしてコメント投稿

python merge_reviews.py review_results.json | gh pr comment $1 -F -- Claude:コードの論理的な問題、パフォーマンス改善点を検出

- GPT-4:可読性、命名規則、ベストプラクティスをチェック

- マージスクリプト:両者の指摘を重複排除して統合

結果(After)

導入後3ヶ月で、以下の改善が見られました。

- レビュー待ち時間:2日→15分(AI即時レビュー後、人間が最終確認)

- レビュー指摘数:平均3件→平均8件(見落としが減少)

- セキュリティ問題の早期発見:本番デプロイ前に2件のSQLインジェクション脆弱性を検出

高橋さんは振り返ります。「単一LLMに頼っていた頃は見落としが多かった。複数の視点でレビューさせるのが正解だった」。

複数のAIを活用した開発効率化については、自律型AIコーディングエージェントも参考になります。

タスク別LLM選定ガイド

ここでは、タスクの種類に応じてどのLLMを選ぶべきかを整理します。

タスク別推奨マッピング

- コード生成・リファクタリング:Claude(長文コンテキスト理解に優れる)

- ドキュメント・README作成:GPT-4o(自然な文章生成)

- 画像・図表を含む分析:Gemini 2.5(マルチモーダル対応)

- データベース設計:Claude(論理的な構造設計)

- UIテキスト・コピー:GPT-4o(創造的な表現)

oh-my-opencodeでの設定例

# ~/.omc/profiles.yaml

profiles:

# コード関連タスク

coding:

primary: claude

fallback: openai

temperature: 0.2

# ドキュメント系

documentation:

primary: openai

fallback: claude

temperature: 0.5

# 分析・調査系

research:

primary: gemini

fallback: claude

temperature: 0.3

# 比較検証用(並列実行)

comparison:

parallel: [claude, openai, gemini]

format: tableAIツールの選定については、MacBookでのローカルLLM構築も選択肢として検討してみてください。

マルチLLM運用でつまずきやすいトラブルと対処法

マルチLLM環境を本番運用に載せるときに、必ずと言っていいほど遭遇する詰まりポイントが4つあります。導入前に対処法を把握しておくと、チーム展開フェーズで時間を溶かさずに済みます。

トラブル1:APIレート制限で並列実行が落ちる

複数のLLMに同時リクエストを投げると、いずれかのプロバイダで1分あたりのリクエスト数(RPM)上限に引っかかることがあります。特にOpenAIの無料枠・低tierアカウントはRPMが低く、並列実行で即失敗しがちです。

対処法は以下の通りです。

- 各プロバイダの管理画面でusage tierを確認し、必要なら有料枠にアップグレードする

- 並列実行ではなく順次実行(sequential)に切り替え、待機時間を挟む

- リトライロジックを組み込み、レート制限エラー時は指数バックオフで再試行する

トラブル2:APIキーの環境変数が読み込まれない

omc ask実行時に「API key not found」エラーが出る場合、exportした環境変数がシェルの再読み込みで反映されていないケースがほとんどです。.envファイルを使っているのにロードしていないパターンも頻出します。

対処法は以下の通りです。

source ~/.bashrc(zshならsource ~/.zshrc)を実行して環境変数を再読み込みecho $ANTHROPIC_API_KEYで値が入っているか直接確認する- プロジェクト単位で

.envを使うならdirenvやdotenv-cliでロードを自動化する - APIキーは絶対にリポジトリへコミットしない(

.gitignoreに.envを追加)

トラブル3:YAML設定ファイルの構文エラーで起動しない

~/.omc/config.yamlは字下げに厳しく、タブとスペースが混在したりインデント幅が不揃いだったりすると起動時に原因不明のエラーが出ます。特にエディタの自動補完でタブが入り込むケースが多いです。

対処法は以下の通りです。

- エディタの設定で「タブをスペース2文字に変換」を有効化する(VSCodeなら

"editor.insertSpaces": true) yamllintやpython -c "import yaml; yaml.safe_load(open('config.yaml'))"で構文チェックする- YAMLが苦手な場合はJSONで記述できるか公式ドキュメントを確認する

トラブル4:並列実行でAPI料金が想定外に膨らむ

比較検証のつもりで並列実行を常用すると、1タスクあたり3つのLLMすべてに課金されるため、月末にクラウド破産級の請求書が届くことがあります。特にGPT-4系とClaude Opus系は入力トークンあたりの単価が高めです。

対処法は以下の通りです。

- 各プロバイダの管理画面で月次の使用上限アラートを設定する(OpenAIなら「Usage limits」)

- 比較検証は開発フェーズのみに限定し、本番運用では単一LLMに絞る

- コスト追跡コマンド(

omc stats --period month等)で毎週使用量を確認する習慣をつける - ローカルLLM(Ollama)を混ぜて、下書きはローカル・本番はクラウドの二段構えにする

本番環境のコスト管理やインフラ選定については、エンジニア向けXServer用途別比較ガイドで紹介しているリモート開発環境の選択肢も合わせて検討すると、クラウドAPI一辺倒からの脱却がしやすくなります。

よくある質問

oh-my-opencodeは無料ですか?

はい、oh-my-opencode自体はオープンソースで無料です。ただし各LLMのAPI利用料は別途かかります。ローカルLLM(Ollama経由)を使えばAPI料金なしでも利用可能です。

並列実行するとAPI料金はどうなりますか?

並列実行では各LLMに対してそれぞれAPI料金が発生します。比較検証時だけ並列実行し、本番運用では1つのLLMに絞るのがコスト効率の良い使い方です。

どのLLMから使い始めるのがおすすめですか?

まずはClaude(コード生成)とGPT-4o(ドキュメント生成)の2つで始めるのがおすすめです。タスク別の得意分野が明確に異なるため、使い分けの効果を実感しやすくなります。

マルチLLMスキルはキャリアアップに有効ですか?

非常に有効です。複数LLMを使い分ける運用経験は、AI活用リードやMLOpsエンジニアとして高く評価されます。LLM実装経験を武器にするエンジニア転職エージェント4社比較やハイクラスエンジニア転職エージェント3社比較で紹介しているエージェントに相談すると、AI領域の高条件ポジションに出会いやすくなります。チームでの導入を進めたいPjMはPjM向け業務効率化SaaS比較でマルチLLMゲートウェイの選定基準も確認してください。

本記事で解説したようなAI技術を、基礎から体系的に身につけたい方は、以下のスクールも検討してみてください。

| 比較項目 | Winスクール | Aidemy Premium |

|---|---|---|

| 目的・ゴール | 資格取得・スキルアップ初心者〜社会人向け | エンジニア転身・E資格Python/AI開発 |

| 難易度 | 個人レッスン形式 | コード記述あり |

| 補助金・給付金 | 教育訓練給付金対象 | 教育訓練給付金対象 |

| おすすめ度 | 幅広くITスキルを学ぶなら | AIエンジニアになるなら |

| 公式サイト | 詳細を見る | − |

まとめ

oh-my-opencodeを使えば、Claude・GPT・Geminiを統一インターフェースで操作し、それぞれの強みを活かしたマルチLLM開発環境を構築できます。

- 統一CLI:複数LLMを同じコマンドで操作

- 並列実行:結果を比較して最適なLLMを選定

- パイプライン:複数LLMを連携させた自動化

- プロファイル:タスク別に最適な設定を保存

単一のLLMに依存するのではなく、タスクに応じて使い分けることで、開発効率と精度を大幅に向上させることができます。

まずはoh-my-opencodeをインストールして、普段のタスクで複数LLMを比較してみてください。

どのLLMが自分のワークフローに最適かが明確になるはずです。