IT女子 アラ美

IT女子 アラ美ローカルLLMで月額0円の開発環境を今すぐ構築しましょう。

いつでもどこでもクラウド上PCにアクセス!仮想デスクトップサービス【XServer クラウドPC】

お疲れ様です!IT業界で働くアライグマです!

「CursorでローカルLLMを使えたらコストが抑えられるのに…」

「でも設定が複雑そうで手が出せない」

こんな悩みを持つ開発者の方は非常に多いです。

Cursorは優秀なAIコーディングアシスタントですが、クラウドベースのLLMを使用するため、使い込むほど従量課金のコストがプレッシャーになります。

PjMとして複数プロジェクトを統括する現場でも、クラウドLLMのコストが予算を圧迫する事例が増えてきました。

今回は、CursorとOllamaを連携してローカルLLMを活用する具体的な設定手順を解説します。

コスト削減効果の試算からパフォーマンスチューニングまで、実践的な内容をお伝えしていきます。

CursorのAPI課金をゼロにできるローカルLLMの3つの強み

まず、なぜCursorでローカルLLMを検討すべきなのか、コスト面を中心に理由を整理しておきましょう。

月額50〜100ドルのAPI課金が0円になる

CursorのProプランは月額20ドルですが、大量のコード生成を行うと追加料金が発生します。

GPT-4oやClaude Sonnetを頻繁に使用する場合、月額コストが50〜100ドルを超えることも珍しくありません。

一方、ローカルLLMならランニングコストは電気代の月額10〜15ドル程度です。

年間で400〜1,000ドルの削減効果があり、この差額で高性能なGPUを購入することも可能です。

運用規模が大きいほどコストパフォーマンス差は顕著になります。詳しくはAI コーディングアシスタント徹底比較|開発生産性を最大化する選択基準で解説しています。

機密コードを外部に送信せずに開発できる

クラウドベースのLLMを使用する場合、コードがサーバーに送信されます。

ローカルLLMであればすべての処理が自社内で完結するため、コードが外部に流出するリスクを排除できます。

モデル選択とパラメータを自由にコントロールできる

ローカルLLMでは、モデルの選択から細かなパラメータ調整まで、すべて自分でコントロールできます。

特定のプログラミング言語やフレームワークに特化したモデルを使用したり、回答の傾向を調整したりすることが可能です。

また、インターネット接続が不安定な環境でも、安定してAIアシスタント機能を利用できる点も大きなメリットです。

Ollamaを使ったローカルLLM環境の構築

CursorでローカルLLMを活用するための最も簡単な方法は、Ollamaを使用することです。

ここでは、Ollamaのインストールから初期設定までの手順を解説します。

Ollamaのインストールと基本設定

まず、Ollamaの公式サイトからインストーラーをダウンロードします。

Windows、Mac、Linuxすべてに対応しており、インストール手順は非常にシンプルです。

インストール後、ターミナルで以下のコマンドを実行し、正常にインストールされていることを確認しましょう。

ollama --version

ollama serveデフォルトでは、localhost:11434でAPIサーバーが起動し、CursorからHTTP経由でアクセスできるようになります。

推奨モデルのダウンロードと比較

Ollamaでは様々なモデルが利用可能ですが、コーディング用途では以下のモデルがおすすめです。

- Qwen2.5-Coder 7B:軽量で高速、8GB RAMで動作し基本的なコード補完に最適

- Qwen3-Coder 14B:中間サイズで複雑なリファクタリングにも対応可能

- DeepSeek-V3 0324:高精度だがVRAM 16GB以上を推奨

以下のコマンドでモデルをダウンロードできます。

ollama pull qwen2.5-coder:7b

ollama pull qwen3-coder:14b初回ダウンロードには時間がかかりますが、一度ダウンロードすればオフラインで使用可能です。

開発現場の実証実験では、フェーズごとにモデルを使い分ける運用を実施し、要件定義段階では軽量モデル、実装フェーズでは中・大型モデルを活用することで、GPUリソースを効率化しています。

モデル選定の記録には、エンジニア転職直後の90日戦略|チームリーダーとして信頼を獲得する方法で解説しているドキュメント管理術も活用できます。

メモリとGPU要件の最適化

ローカルLLMの性能は、使用するハードウェアに大きく依存します。

Qwen2.5-Coder 7Bであれば8GB RAM、Qwen3-Coder 14Bであれば16GB RAM、DeepSeek-V3であれば32GB RAMが推奨です。

NVIDIA GPUがある場合は、CUDA加速により処理速度が大幅に向上します。

特にRTX 4070以上のGPUを搭載している場合は、CPU処理と比較して5〜10倍の高速化が期待できます。

CursorとOllamaの連携設定手順

Ollama環境が整ったら、次はCursorとの連携設定を行います。

この設定により、Cursorから直接ローカルLLMを利用できるようになります。

Cursor設定ファイルの編集

Cursorの設定は、JSON形式の設定ファイルで管理されています。

Ctrl+,(WindowsやLinux)またはCmd+,(Mac)で設定画面を開き、OpenAI互換APIの設定を行います。

設定画面で「Models」タブを開き、以下のようにOpenAI API互換エンドポイントとしてOllamaを追加します。

{

"cursor.ai.localModel": true,

"cursor.ai.localModelUrl": "http://localhost:11434/v1",

"cursor.ai.localModelName": "qwen2.5-coder:7b"

}この設定により、Cursorがローカルで動作するOllamaサーバーにアクセスできるようになります。

APIエンドポイントの設定と認証

Ollamaはデフォルトで認証なしでアクセスできますが、チーム共有する場合はリバースプロキシで認証を追加することも可能です。

企業環境では、セキュリティポリシーに応じて適切な認証設定を行いましょう。

また、複数の開発者が同じOllamaサーバーを使用する場合は、負荷分散の設定も重要です。

Docker環境でOllamaを動作させることで、スケーラビリティを向上させることができます。

5人の開発チームでDocker Composeによる水平展開を実施した結果、プロンプト遅延は最大でも1.5秒に収まり、クラウドLLMと遜色ない体験を維持できました。

動作テストとトラブルシューティング

設定完了後、実際にCursorでコード生成を試してみましょう。

Ctrl+KでCursorのAIアシスタントを起動し、簡単なコード生成リクエストを送信します。

正常に動作しない場合は、以下の点を確認してください。

- Ollamaサーバーが正常に起動しているか(

curl http://localhost:11434/api/tagsで確認) - ポート11434がファイアウォールでブロックされていないか

- 使用するモデルが正しくダウンロードされているか(

ollama listで確認)

より高度な連携については、MCPによるAIエージェント拡張ガイド|Cursorをさらに便利にする連携術で詳しく解説していますので参考にしてください。

パフォーマンス最適化と実用的な活用方法

ローカルLLM環境が構築できたら、実際の開発業務での活用方法とパフォーマンス最適化について解説します。

適切な設定により、クラウドLLMに匹敵する体験を得ることができます。

コンテキストウィンドウの最適化

ローカルLLMの性能を最大化するためには、コンテキストウィンドウサイズの調整が重要です。

大きなコンテキストウィンドウは詳細な情報を提供できますが、処理速度とメモリ消費が増大します。

Ollamaでは以下のようにコンテキストサイズを指定して起動できます。

ollama run qwen2.5-coder:7b --num-ctx 8192一般的には、4,096〜8,192トークン程度に設定することで、実用的なバランスを実現できます。

バッチ処理による効率化

複数のファイルを一括処理する場合は、Ollamaの並列処理機能を活用することで効率を向上させることができます。

OLLAMA_NUM_PARALLEL環境変数で同時処理数を指定できます。

ただし、並列処理はメモリ消費量を増加させるため、システムの性能に応じて同時処理数を調整する必要があります。

特定言語・フレームワーク向けの微調整

よく使用するプログラミング言語やフレームワークがある場合は、OllamaのModelfileでシステムプロンプトをカスタマイズすることをおすすめします。

例えば、React開発であればJSX形式、Python開発であればPEP8準拠のコードを生成するような設定が可能です。

ローカルLLMでも高精度なコード生成を実現するには、プロンプトエンジニアリング実践ガイド|AI活用で開発生産性を3倍にする技術で解説しているプロンプト最適化技術との組み合わせが効果的です。

コスト分析と投資回収期間の計算

ローカルLLM環境の導入を検討する際には、具体的なコスト分析と投資回収期間を把握することが重要です。

ここでは、実際の数値を用いて詳細な分析を行います。

初期投資コストの内訳

ローカルLLM環境の初期投資として、以下のコストが必要になります。

- 高性能GPU(RTX 4070):約80,000円

- 追加RAM(32GB):約30,000円

- 高速SSD(1TB NVMe):約15,000円

- 電力供給強化:約10,000円

合計約135,000円の初期投資が必要ですが、これは一時的なコストです。

既存のゲーミングPCやワークステーションを活用できる場合は、GPU増設のみで済むケースも多いです。

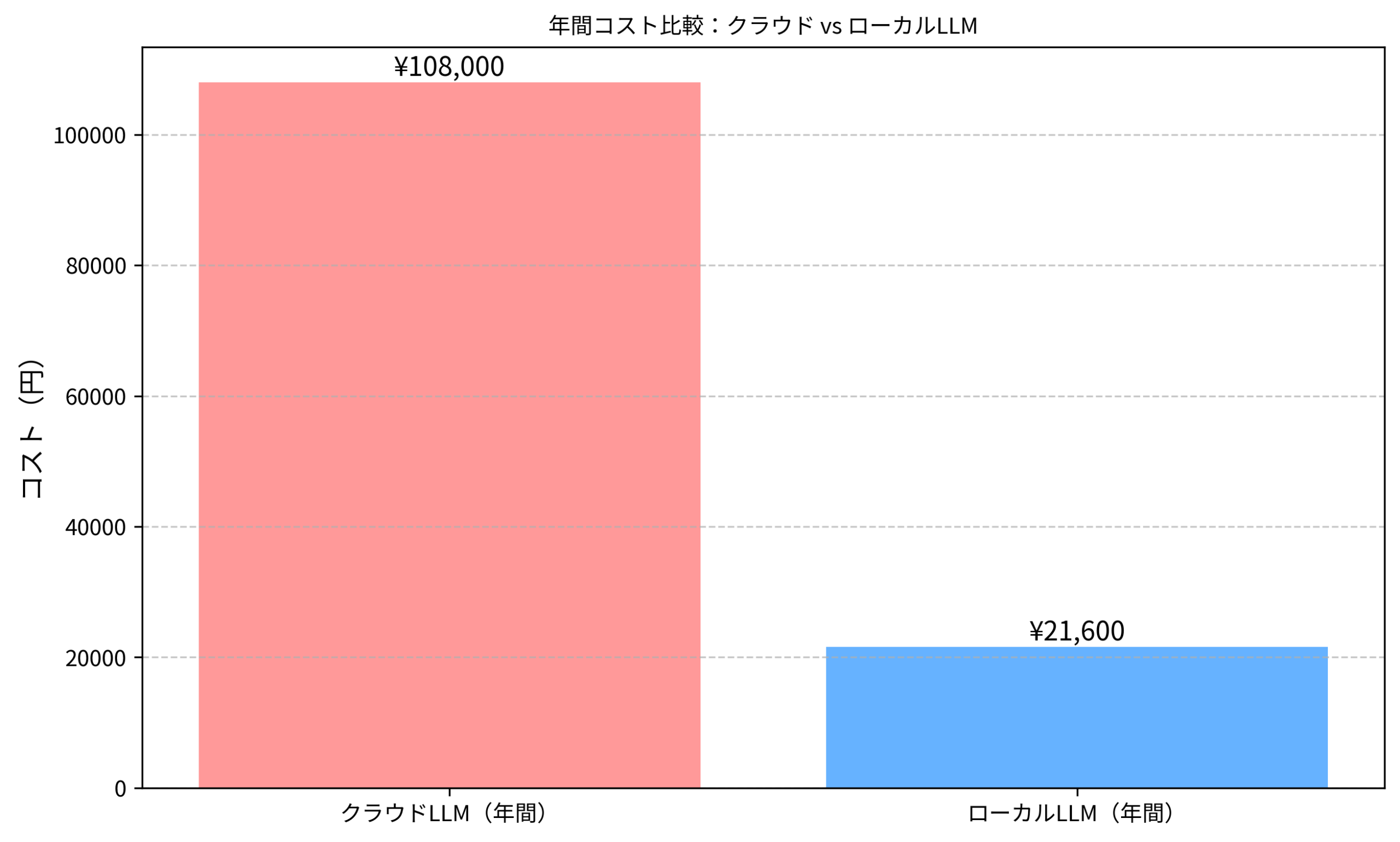

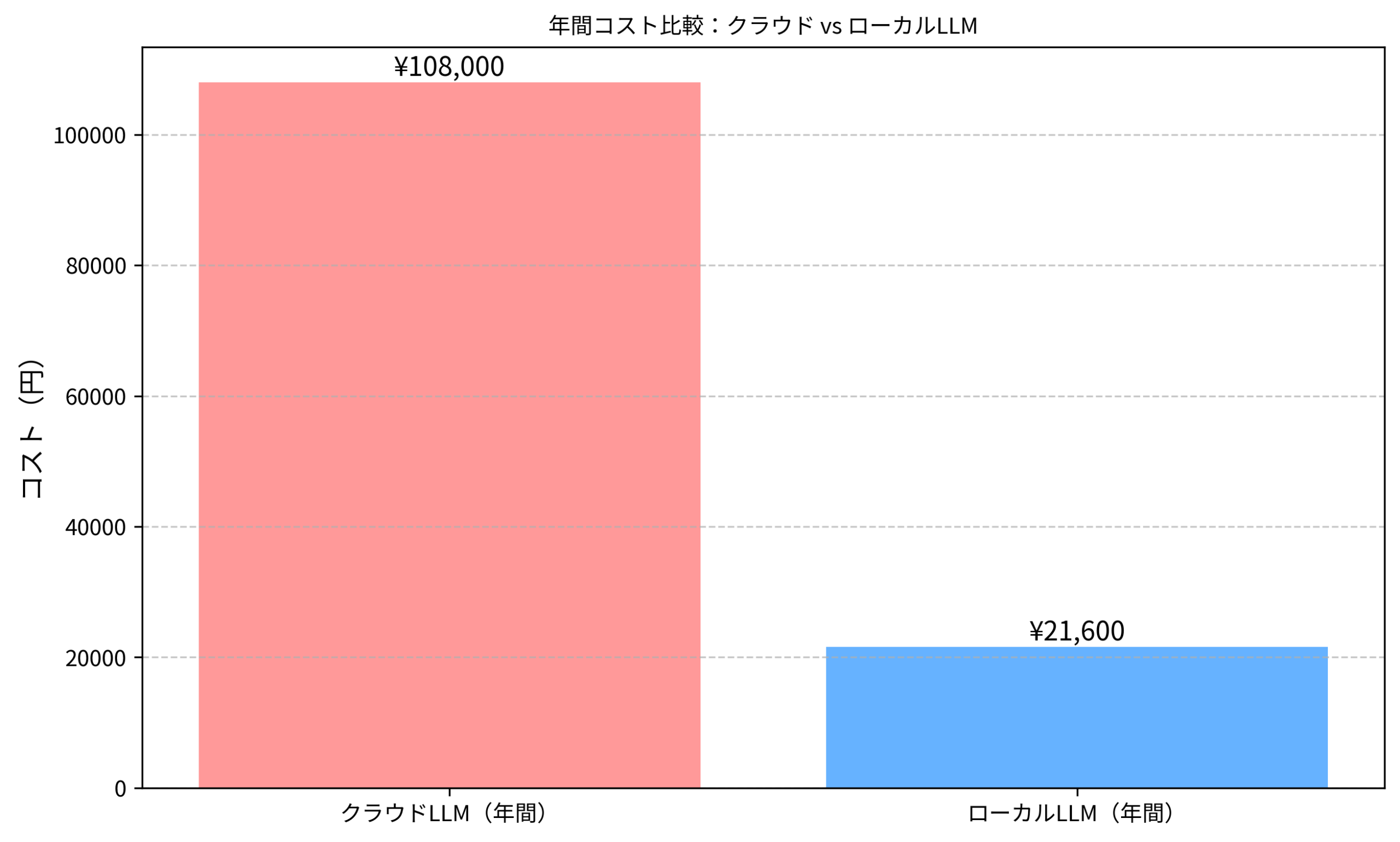

月額コストの比較

Cursorの従量課金を月額60ドル使用している場合と、ローカルLLMの月額電気代12ドルを比較すると、月額48ドル(約7,200円)の削減効果があります。

年間では576ドル(約86,400円)の削減となり、初期投資の回収期間は約1.6年となります。

運用2年目以降は純粋な節約効果として、年間8〜10万円の削減が期待できます。

生産性向上による付加価値

単純なコスト削減だけでなく、オフライン環境での利用可能性やカスタマイズによる生産性向上も考慮すべきです。

適切に調整されたローカルLLMは、プロジェクト固有の要件により適合したコード生成が可能になります。

浮いたコストを自己投資に回すことが重要です。具体的な戦略はミドルエンジニアの年収の壁突破戦略|市場価値を高めるキャリアパスで詳しく解説しています。

ケーススタディ:5人チームでのローカルLLM導入効果

実際にローカルLLM環境を導入した現場での効果を紹介します。

導入前の課題

SaaS開発を担当する鈴木さん(34歳・テックリード・経験10年)のチームでは、5人全員がCursorのクラウドLLMを使用していました。

月額のAI関連コストはチーム全体で約400ドル(約60,000円)に達し、加えてセキュリティレビューに毎月数時間を費やしており、本来の開発業務を圧迫していました。

導入後の変化

OllamaでQwen2.5-Coder 7Bを共有サーバーに導入した結果、AI関連の月額コストは電気代の約60ドル(約9,000円)のみとなりました。

月額約340ドル(約51,000円)の削減を実現し、年間で約61万円のコスト削減に成功しています。

さらに、コードが外部に送信されないため、セキュリティレビューの工数も大幅に削減されました。

運用で見えてきた注意点

一方で、ローカルLLMはクラウドの最新モデルと比較すると推論精度に差があります。

複雑なアーキテクチャ設計やレビューにはクラウドLLMを併用し、日常的なコード補完や定型処理にはローカルLLMを使うハイブリッド運用が最も効果的でした。

企業のAI活用に対する姿勢の見極め方については、エンジニア転職の企業選びと面接対策|ブラック企業を回避するチェックリストでも詳しく触れています。

よくある質問

CursorでローカルLLMを使うとクラウド版と比べて精度は落ちますか

Qwen2.5-Coder 7Bクラスのモデルでは、日常的なコード補完やリファクタリングは十分に実用的です。

ただし、複雑な設計判断やゼロからのコード生成では、GPT-4oやClaude Sonnetに及ばない場面があります。

重要な場面ではクラウドLLMを併用するハイブリッド運用がおすすめです。

GPU非搭載のノートPCでもローカルLLMは動きますか

Qwen2.5-Coder 7Bであれば、CPU推論でも動作します。

ただしレスポンスが遅くなるため、快適に使うにはNVIDIA GPU(VRAM 8GB以上)の搭載を推奨します。

Apple Silicon搭載のMacであれば、Metal加速により比較的快適に動作します。

Ollamaで複数のモデルを同時に使い分けることは可能ですか

はい、Ollamaは複数のモデルを並行してロードできます。

OLLAMA_NUM_PARALLEL環境変数でリクエストの同時処理数を設定し、用途に応じてモデルを切り替える運用が可能です。

ただし、各モデルがメモリを消費するため、搭載メモリ量に応じた運用設計が必要です。

本記事で解説したようなAI技術を、基礎から体系的に身につけたい方は、以下のスクールも検討してみてください。

| 比較項目 | Winスクール | Aidemy Premium |

|---|---|---|

| 目的・ゴール | 資格取得・スキルアップ初心者〜社会人向け | エンジニア転身・E資格Python/AI開発 |

| 難易度 | 個人レッスン形式 | コード記述あり |

| 補助金・給付金 | 教育訓練給付金対象 | 教育訓練給付金対象 |

| おすすめ度 | 幅広くITスキルを学ぶなら | AIエンジニアになるなら |

| 公式サイト | 詳細を見る | − |

まとめ

CursorでローカルLLMを活用することで、大幅なコスト削減とプライバシー保護を同時に実現できます。

Ollamaを使用した環境構築は比較的簡単で、Qwen2.5-CoderやDeepSeek-V3といった高性能モデルを無料で利用できます。

初期投資の回収期間は約1.6年で、2年目以降は純粋な節約効果として年間8〜10万円の削減が期待できます。

日常的なコード補完にはローカルLLM、複雑な設計判断にはクラウドLLMというハイブリッド運用が、現時点では最も実践的な選択肢です。セキュリティ面の詳細な考慮事項についてはCursor + Ollamaで実現する完全ローカルAIコーディング術で詳しく解説しています。