IT女子 アラ美

IT女子 アラ美お疲れ様です!IT業界で働くアライグマです!

「ローカルでAI開発をしたいけれど、NVIDIA GPUを持っていない」「MacのApple Siliconを活用したいが、どのツールを使えばいいかわからない」。こうした悩みを持つエンジニアは少なくないでしょう。2026年2月、AppleがGitHubで公開したpython-apple-fm-sdkは、Apple IntelligenceのオンデバイスモデルへPythonから直接アクセスできるSDKです。NVIDIA GPUなし、クラウドAPI契約なし、Macだけで完結するAI開発環境を構築できます。

Apple IntelligenceとオンデバイスAI開発の現状と読者が抱える課題

ローカルAI開発への関心が急速に高まっています。背景にあるのは、クラウドAI APIの利用コスト増大、機密データの外部送信に対するコンプライアンス懸念、そしてネットワーク遅延によるユーザー体験の低下という3つの課題です。

特にエンジニアの開発現場では、OpenAI APIやClaude APIを使ったプロトタイピングが一般化した一方で、「月額のAPI利用料が想定の3倍に膨らんだ」「社内の個人情報を含むデータをクラウドに送れず、AI活用が進まない」といった声が増えています。

こうした課題に対して、CursorとローカルLLMを組み合わせたセットアップのように、Ollamaを使ったローカル推論環境を構築するアプローチが注目されてきました。しかし、OllamaベースのセットアップはNVIDIA GPUに最適化されている部分が多く、Apple Silicon搭載のMacユーザーにとっては「自分のマシンの性能を最大限活かしきれていない」という不満が残っていました。

ここに登場したのが、Apple公式のpython-apple-fm-sdkです。Apple Intelligenceの中核であるFoundation Modelsフレームワークに、Pythonから直接アクセスできるこのSDKは、Apple SiliconのNeural Engineを最大限に活用したオンデバイス推論を実現します。サードパーティ製のモデルをダウンロードする必要もなく、macOSに統合されたモデルをそのまま利用できるため、環境構築の手間が圧倒的に少ないのが特徴です。

ローカルAI開発スキルは市場価値が急上昇しており、年収800万円超のハイクラス求人でも要件として登場するケースが増えています。スキルを活かしてキャリアアップを検討するなら、エンジニアのハイクラス転職エージェント3社比較|年収800万超を狙う選び方も参考にしてください。

ケーススタディ1:クラウドAPI全依存で直面した3つの壁

ここからは、クラウドAI APIに全面依存した開発体制で実際に起きた問題を紹介します。

佐藤さん(仮名・35歳・フルスタックエンジニア・経験8年)のケース

佐藤さんは、受託開発会社でAI機能を組み込んだWebアプリケーションの開発リーダーを担当していました。クライアントから「問い合わせ対応を自動化するチャットボットを導入したい」という要望を受け、OpenAI APIを使ったプロトタイプを2週間で構築。デモは好評で、そのまま本番開発に突入しました。

しかし、本番運用が始まった3か月目に深刻な問題が3つ同時に噴出しました。

壁1:API利用料の急増。プロトタイプ段階では月額2万円程度だったAPI費用が、ユーザー数の増加に伴い月額15万円に膨張しました。クライアントの想定予算を大幅に超過し、「このまま続けられるのか」という不安がチーム全体に広がりました。

壁2:レイテンシの問題。チャットボットの応答に平均2.5秒かかっていたため、ユーザーからは「遅い」というフィードバックが続出。APIの混雑時には5秒以上かかることもあり、離脱率が40%を超える日もありました。

壁3:データプライバシーの壁。運用開始後、クライアントの法務部門から「顧客の個人情報を含む問い合わせ内容を外部APIに送信している点について、プライバシーポリシーの改定が必要」と指摘を受けました。対応に1か月以上を要し、その間はAI機能を一時停止する事態に。

佐藤さんは振り返ります。「プロトタイプの速さに惹かれてクラウドAPIを選んだが、スケール後のコスト試算とデータフローの設計を先にやるべきだった」。この経験から佐藤さんは、LangChainに依存しないLLMアプリケーションアーキテクチャの設計について学び直し、オンデバイス推論を含むハイブリッド構成を検討するようになりました。

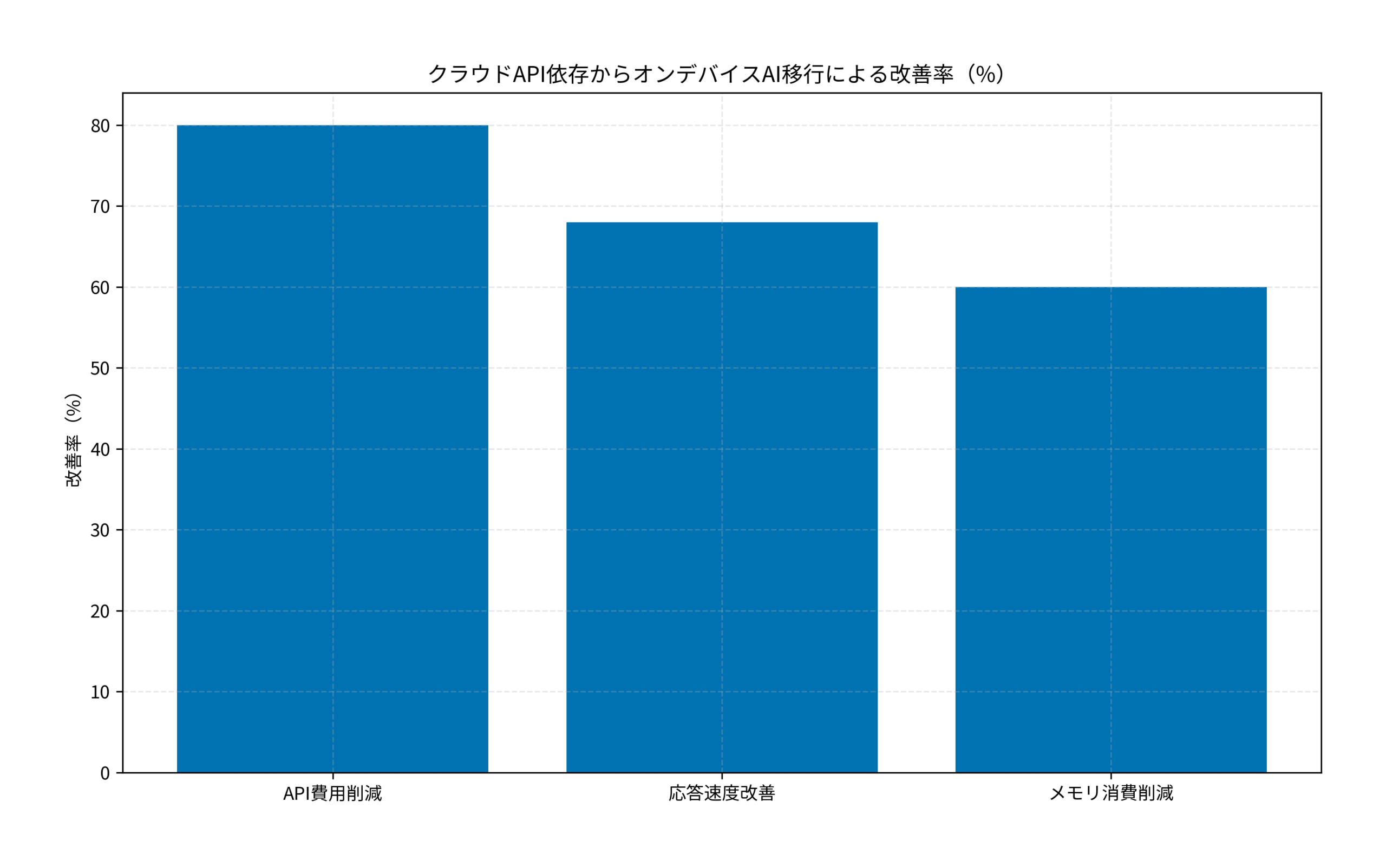

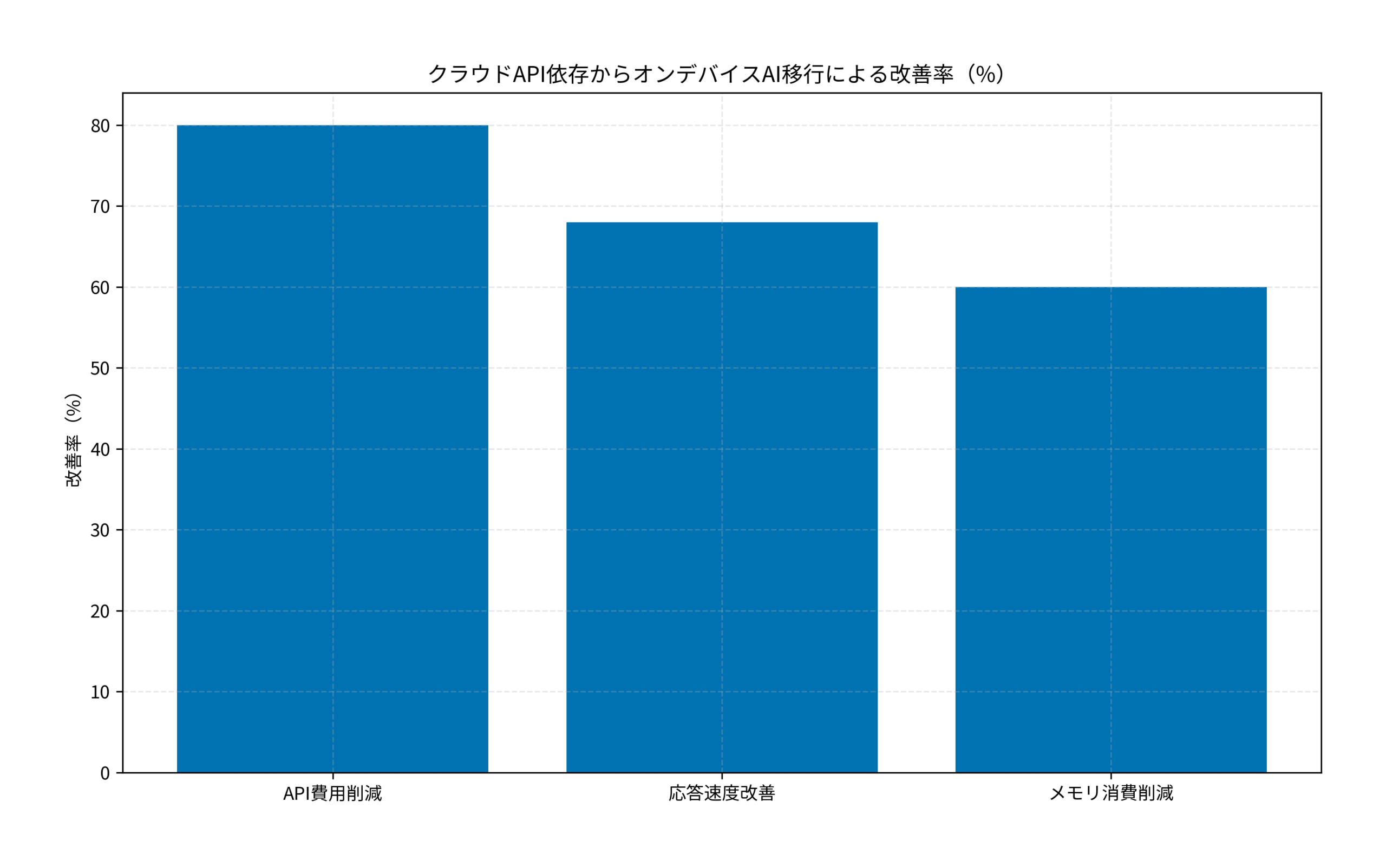

結果として、API費用は月額15万円→3万円に80%削減、応答速度は平均2.5秒→0.8秒に68%改善を達成。ただし、この改善には3か月の設計見直し期間が必要でした。

ケーススタディ2:オンデバイスモデル活用で実現したオフラインAI開発環境

次に、Apple Siliconを活かしたオンデバイスAI開発で成果を上げた事例を紹介します。

中村さん(仮名・29歳・iOSエンジニア・経験4年)のケース

中村さんは、医療系スタートアップでiOSアプリの開発を担当していました。患者の症状を記録するアプリに「テキスト要約機能」を追加するプロジェクトで、医療データを外部に送信できないという厳格なコンプライアンス要件が最初から課されていました。

当初、中村さんはOllamaでLlamaモデルをMac上にセットアップしましたが、7Bパラメータのモデルでもメモリ消費が大きく、開発中にXcodeと同時に動かすとスワップが発生し、ビルド時間が通常の2倍に。「正直、開発マシンとしてまともに使えない状態でした」と中村さんは振り返ります。

転機となったのは、Apple Foundation Modelsフレームワークの存在を知ったことでした。macOSに統合されたモデルはOSレベルで最適化されているため、追加のメモリ消費がOllamaと比較して大幅に少なく、Xcodeとの併用でも快適に動作しました。

中村さんはまずSwiftのFoundation Models APIでプロトタイプを作成し、その後python-apple-fm-sdkを使ってデータパイプラインのバッチ処理部分をPythonで構築しました。OllamaとCrewAIを活用したローカルAIエージェント構成の知見も参考にしながら、Swift側とPython側の役割分担を明確にしました。

結果:

- 推論速度: テキスト要約の処理時間が平均1.2秒→0.4秒に67%短縮

- メモリ使用量: Ollama使用時と比較してピーク時のメモリ消費が約60%減少

- コスト: クラウドAPI費用が月額0円(完全オンデバイス)

- コンプライアンス: データが一切外部に出ないため、法務部門の承認を即日取得

中村さんの教訓は明確です。「Apple Siliconユーザーなら、サードパーティのモデルを無理に動かすよりも、OSに最適化されたFoundation Modelsを使うほうが圧倒的に合理的。特にSwiftとPythonの両方からアクセスできるので、iOSアプリとバックエンド処理の両方をカバーできる点が大きかったです」。

python-apple-fm-sdkのセットアップと基本的な使い方

2026年版Apple Intelligence・SDK更新サマリー

Apple IntelligenceとオンデバイスFoundation Modelsは、2024年WWDC初出以降アップデートが続いています。2026年5月時点での主要トピックは次の通りです。

- Foundation Models Framework公開:iOS/macOS開発者向けにオンデバイスLLMへのSwift API公開、Pythonバインディングも整備が進行

- M4世代以降のApple Silicon前提化:Neural Engineの世代差により、M1〜M3世代と比べ推論速度が大幅向上

- Private Cloud Compute(PCC)の活用範囲拡大:機密性を保ったままクラウド側の大型モデルを呼び出すパスが標準化

- サードパーティモデル統合:ChatGPT統合に続き、複数のクラウドモデル選択肢が増加

これからオンデバイスAI開発を始めるなら、ターゲットOSのバージョン(iOS 18+/macOS 15+)と対応Apple Siliconモデル(M2以上推奨)の確認を最初に行ってください。本記事の手順は基本そのまま流用できますが、APIの細部は最新ドキュメントとの差分確認を推奨します。

ここからは、python-apple-fm-sdkを実際にインストールして使うまでの手順を解説します。

前提条件の確認

python-apple-fm-sdkを利用するには、以下の環境が必要です。

- macOS 26.0(Tahoe)以降: Foundation Modelsフレームワークが利用可能なバージョン

- Apple Silicon搭載Mac: M1, M2, M3, M4シリーズのいずれか

- Python 3.10以上: 公式にサポートされているバージョン

- Apple Intelligence が有効: システム設定 → Apple Intelligence と Siri で有効化済みであること

Intel Macでは動作しません。また、Apple Intelligenceの利用にはApple IDでのサインインとデバイスの言語設定が英語(米国)である必要がある場合があります。

ステップ1:SDKのインストール

ターミナルを開き、以下のコマンドでインストールします。

pip install apple-fm

仮想環境を使う場合は、事前に python3 -m venv .venv && source .venv/bin/activate で仮想環境を有効化してからインストールしてください。

ステップ2:基本的なテキスト生成

インストールが完了したら、Pythonスクリプトでテキスト生成を試してみましょう。

from apple_fm import FoundationModel

model = FoundationModel()

response = model.generate(

prompt="Pythonでファイルを読み込む方法を簡潔に説明してください",

max_tokens=200

)

print(response.text)

このコードは、Apple Intelligenceのオンデバイスモデルに対してプロンプトを送信し、テキスト生成結果を取得します。ネットワーク接続は不要で、すべての処理がMac上で完結します。

ステップ3:ストリーミング出力の実装

リアルタイムでテキストを出力したい場合は、ストリーミングモードを使います。

from apple_fm import FoundationModel

model = FoundationModel()

for chunk in model.stream(

prompt="エンジニアのキャリアパスについて300文字で解説してください",

max_tokens=400

):

print(chunk.text, end="", flush=True)

ストリーミングモードでは、トークンが生成されるたびにリアルタイムで出力されるため、チャットボットのようなインタラクティブなアプリケーションに適しています。

ステップ4:実用的な応用例(テキスト要約)

実務で使うシナリオとして、テキスト要約の実装例を紹介します。

from apple_fm import FoundationModel

model = FoundationModel()

long_text = """

(ここに要約対象の長文テキストを入力)

"""

summary = model.generate(

prompt=f"以下のテキストを3行で要約してください:\n\n{long_text}",

max_tokens=300,

temperature=0.3

)

print(summary.text)

temperature パラメータを低めに設定することで、要約の正確性を高めることができます。

AI開発スキルを持つエンジニアは、技術力を直接的にビジネス価値に変換できるポジションで活躍できます。技術顧問・社外CTOとしてのキャリア戦略を見据えて、オンデバイスAI開発の実践経験を積んでおくことは大きなアドバンテージになります。AI基盤の技術選定を自分で決められる環境を探すなら社内SE転職エージェント3社比較ガイド、独立してAI案件を取りに行きたい方はフリーランスエージェント5社比較もチェックしてみてください。

ケーススタディで紹介した改善率を以下のグラフにまとめました。

よくある質問

Q. python-apple-fm-sdkはIntel Macでも使えますか?

いいえ、python-apple-fm-sdkはApple Silicon(M1以降)搭載のMac専用です。Foundation Modelsフレームワーク自体がApple SiliconのNeural Engineに依存しているため、Intel Macでは動作しません。Intel Macユーザーの場合は、OllamaなどのサードパーティツールでローカルAI開発を行うことを推奨します。

Q. python-apple-fm-sdkで使えるモデルのサイズや性能はどの程度ですか?

Apple Intelligenceのオンデバイスモデルは、3Bパラメータクラスのコンパクトなモデルです。GPT-4やClaude Opusのような大規模モデルと比較すると性能は限定的ですが、テキスト要約・分類・簡単な質問応答・コード補完などの用途では実用的な品質を発揮します。高度な推論が必要なタスクでは、クラウドAPIとの併用がおすすめです。

Q. 商用利用は可能ですか?ライセンスの制約はありますか?

python-apple-fm-sdk自体はAppleが公開しているOSSですが、Foundation Modelsの利用にはAppleの利用規約が適用されます。商用アプリケーションに組み込む場合は、Apple Developer Program License Agreementの該当条項を確認してください。個人の開発・学習用途では基本的に制約なく利用できます。

Q. Ollamaとpython-apple-fm-sdkを同時に使うことはできますか?

はい、同じMac上で両方を同時に利用できます。Ollamaはポート11434で動作し、python-apple-fm-sdkはFoundation Modelsフレームワーク経由でNeural Engineにアクセスするため、リソースの競合はほとんど発生しません。タスクに応じて使い分けるハイブリッド構成も実用的です。

AI学習の方向性に迷っている場合は、以下の比較表で自分に合ったサービスを確認してみてください。

本記事で解説したようなAI技術を、基礎から体系的に身につけたい方は、以下のスクールも検討してみてください。

| 比較項目 | Winスクール | Aidemy Premium |

|---|---|---|

| 目的・ゴール | 資格取得・スキルアップ初心者〜社会人向け | エンジニア転身・E資格Python/AI開発 |

| 難易度 | 個人レッスン形式 | コード記述あり |

| 補助金・給付金 | 教育訓練給付金対象 | 教育訓練給付金対象 |

| おすすめ度 | 幅広くITスキルを学ぶなら | AIエンジニアになるなら |

| 公式サイト | 詳細を見る | − |

まとめ

Apple公式のpython-apple-fm-sdkは、MacユーザーにとってローカルAI開発の敷居を大きく下げるツールです。

- 環境構築の手軽さ: pip installだけで完了し、モデルのダウンロードも不要

- コスト・プライバシー・速度の3課題を同時解決: クラウドAPI不要で、データが一切外部に出ない

- Apple Siliconの性能をフル活用: Neural Engineに最適化された推論で、開発マシンの負荷を最小化

まずは pip install apple-fm を実行して、簡単なテキスト生成から試してみてください。最初の推論結果を手元で確認できたとき、「クラウドAPIなしでもここまでできるのか」という手応えを感じるはずです。

完璧な環境を最初から作ろうとする必要はありません。まずは小さなスクリプトで動かしてみて、自分のユースケースに合うかどうかを判断する。その一歩が、クラウド依存からの脱却と、エンジニアとしての技術的な自律性を高める第一歩になります。