IT女子 アラ美

IT女子 アラ美お疲れ様です!IT業界で働くアライグマです!

先日、チームメンバーから「プロモーション動画を作りたいんですが、デザイナーに依頼すると2週間かかるんですよね」という相談を受けました。「AI動画生成なら数分でプロトタイプが作れるよ」と返したところ、実際にLTX-2をセットアップして試してもらい、当日中にラフ動画が完成。結果的にデザイナーとの打ち合わせに使う素材として活用でき、最終納品までの期間が1週間短縮されました。

この記事では、Lightricksが開発したオープンソース動画生成モデル「LTX-2」のローカル環境構築から実際の動画生成までを、実装手順とともに解説します。

LTX-2とは何か:Lightricks製動画生成AIの特徴

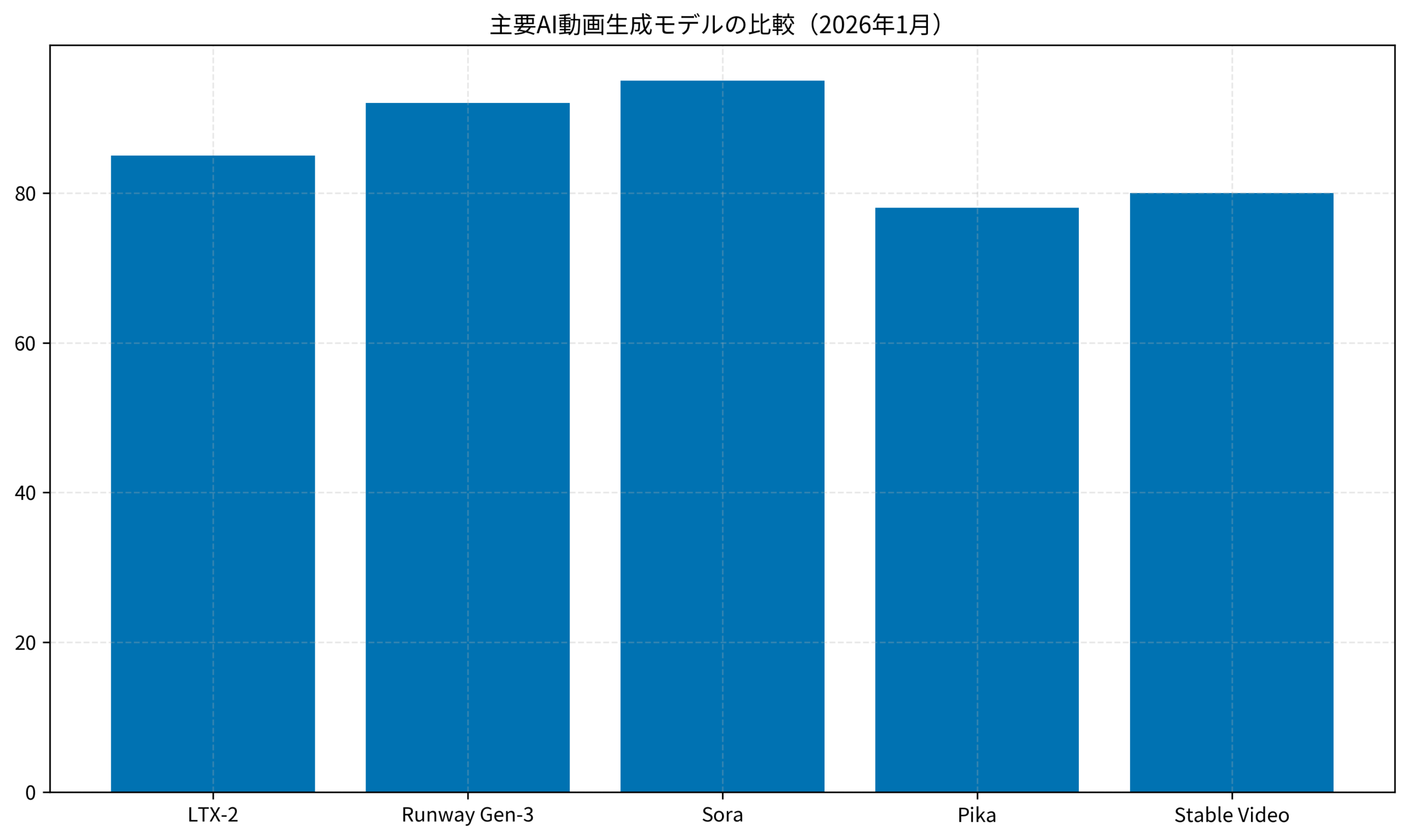

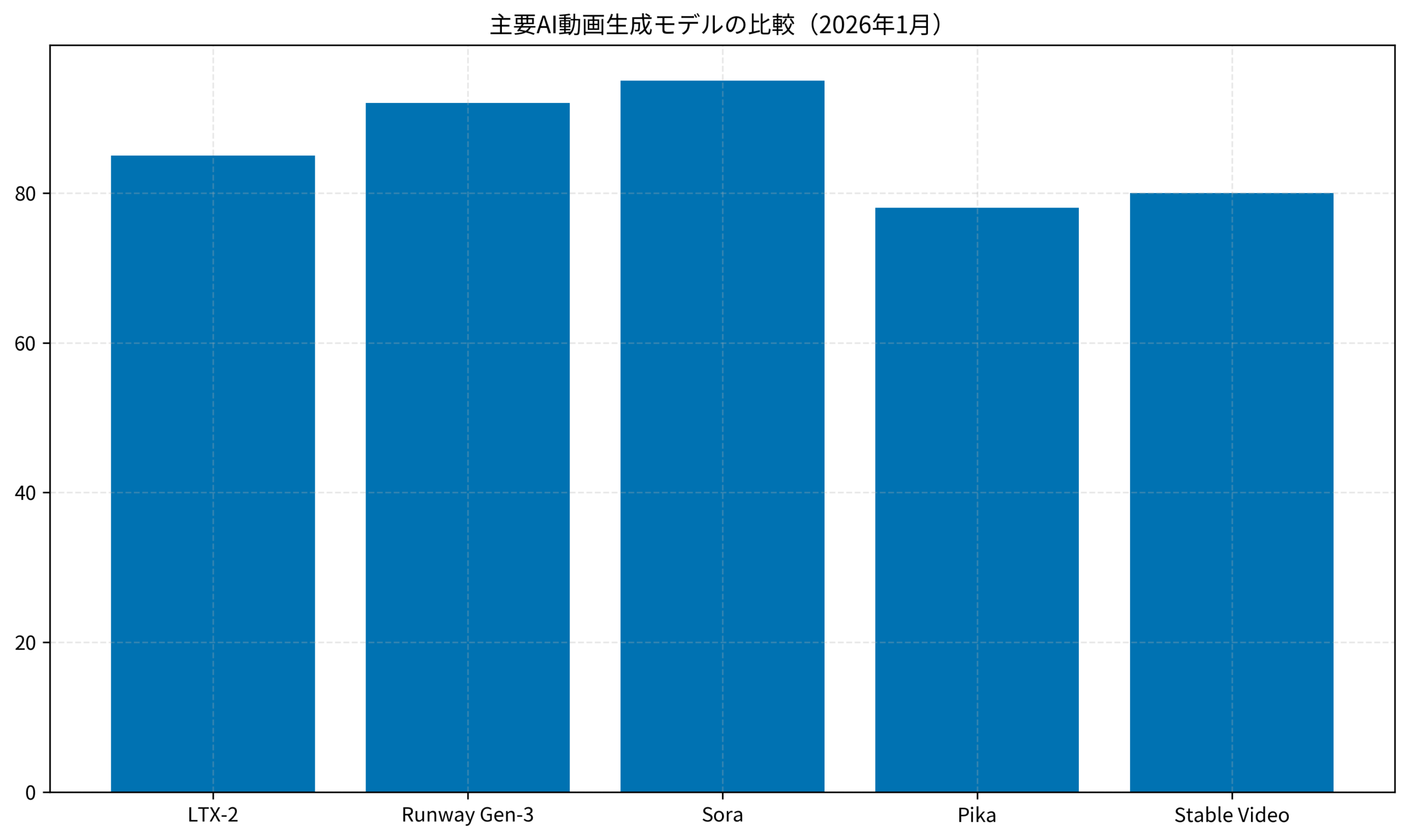

LTX-2は、イスラエルの写真・動画編集アプリ企業Lightricksが開発したオープンソースの動画生成AIモデルです。2026年1月にGitHub上で公開され、短期間で700以上のスターを獲得しています。

LTX-2の主な特徴

- テキストから動画を生成:プロンプト入力だけで短尺動画を自動生成

- 画像から動画へ拡張:静止画をベースにモーションを付与

- ローカル実行可能:クラウドAPIではなく自前のGPU環境で実行できる

- Apache 2.0ライセンス:商用利用を含めて自由に使える

競合であるSoraやRunway Gen-3がクラウドベース(従量課金)であるのに対し、LTX-2はローカル環境で無制限に実行できる点が大きなメリットです。

また、Lightricksは以前かFacetuneやVideoleapなどの人気アプリを開発してきた実績があり、動画・画像処理のノウハウが蓄積されています。

アカデミア発のモデルとは異なり、実務での使いやすさを意識した設計がなされているのが特徴です。

公式リポジトリ:https://github.com/Lightricks/LTX-2

他のAI動画生成技術については、HY-Motion-1.0で始める3Dキャラクターアニメーション生成も参考になります。

ローカル環境構築:必要なハードウェアとセットアップ手順

LTX-2をローカルで動かすための環境構築手順を解説します。

必要なハードウェア要件

- GPU:NVIDIA RTX 3090以上(24GB VRAM推奨)

- RAM:64GB以上を推奨

- ストレージ:モデルファイルで約20GB必要

- CUDA:11.8以上

16GB VRAMのGPU(RTX 4080など)でも動作しますが、生成時間が長くなる傾向があります。

クラウドGPUサービス(runpod、Lambda Labs、Google Colab Proなど)を利用すれば、ローカルにGPUがなくても試せます。

runpodのRTX 4090インスタンスなら時間あたり約1ドル程度で利用可能です。

セットアップ手順

# リポジトリをクローン

git clone https://github.com/Lightricks/LTX-2.git

cd LTX-2

# 仮想環境を作成

python3 -m venv venv

source venv/bin/activate

# 依存パッケージをインストール

pip install -r requirements.txt

# モデルファイルをダウンロード

python scripts/download_models.pyモデルのダウンロードには約20分かかります。完了後、以下のコマンドで動作確認ができます。

# テスト生成

python generate.py --prompt "A cat walking through a garden" --output test.mp4AIを活用した開発の自動化については、IQuest-Coderで実現する自律型AI開発でも解説しています。

テキストから動画を生成する:プロンプト設計とパラメータ調整

環境構築が完了したら、実際にテキストから動画を生成してみましょう。

基本的な生成コマンド

from ltx2 import VideoGenerator

# モデルを初期化

generator = VideoGenerator(model_path="./models/ltx2_base.pt")

# プロンプトから動画を生成

video = generator.generate(

prompt="A futuristic city skyline at sunset, flying cars passing by",

num_frames=48, # フレーム数(48=約2秒)

fps=24, # フレームレート

width=512, # 解像度(幅)

height=512, # 解像度(高さ)

guidance_scale=7.5 # プロンプトへの忠実度

)

# 動画を保存

video.save("output.mp4")プロンプト設計のコツ

- 具体的なシーン描写:「A cat」より「An orange tabby cat walking through a sunlit garden」の方が良い結果に

- カメラワークの指定:「slow zoom in」「tracking shot」などのキーワードを追加

- lighting/atmosphere:「golden hour」「neon-lit」などで雰囲気を指定

AI生成の他の活用例としては、gemini-writerで始めるAI小説生成もおすすめです。

ケーススタディ:プロモーション動画のプロトタイプ作成

クラウドPCで高性能GPU環境を手軽に構築して、今すぐ試しなさい

いつでもどこでもクラウド上PCにアクセス!仮想デスクトップサービス【XServer クラウドPC】

ここでは、森田さん(仮名・34歳・PdM・経験9年)がLTX-2を使ってプロモーション動画のプロトタイプを作成した事例を紹介します。

状況(Before)

- SaaSプロダクトの新機能リリースに合わせてティザー動画を作成したい

- デザイナーへの依頼は2週間待ち、予算は30万円程度

- 過去2回のリリースでデザイナーとの方向性のズレが発生し、手戻りで納期が遅延

- まずはラフ動画を作って関係者の認識を揃えたい

行動(Action)

- LTX-2をRTX 4090搭載のワークステーションにセットアップ(Ubuntu 22.04、CUDA 12.1、PyTorch 2.1環境、git cloneからpip installまで約30分)

- プロモーション内容に合わせたプロンプトを5パターン作成(「A sleek app interface animation, neon glow, slow zoom in」「Minimalist tech product reveal, white background, tracking shot」など)

- 各プロンプトで3秒×3パターン=15本の動画を生成(

python generate.py --prompt "..." --num_frames 72 --output video_01.mp4、生成時間約1本2分、合計30分) - 生成した15本の動画からアーティファクトの少ない3本を目視で選定し、DaVinci Resolve 18でトリミング・テロップ・フェード編集を実施(約30分)

- 社内Slackの#video-reviewチャンネルで共有し、PM・マーケ・デザイナーの3名からフィードバックを収集(「もう少し明るい雰囲気で」などの具体的な指摘)

- フィードバックを基にプロンプトに

golden hour lightingを追加して再生成、最終版のラフ動画を完成

結果(After)

- ラフ動画の完成まで半日(約4時間)で完了

- デザイナーとの打ち合わせ時に「こういう方向で」と具体的に伝えられるようになり、手戻りが減少

- 最終的なデザイナー作業は1週間(従来の半分)に短縮

- プロトタイプ作成コストは実質ゼロ(電気代のみ)

ローカルLLM環境の構築については、CursorでローカルLLMをセットアップする完全ガイドも合わせてご覧ください。

LTX-2の活用シーンと注意点

LTX-2を実務で活用する際のユースケースと、注意すべきポイントを整理します。

活用シーン

- プロトタイプ・ラフ動画の作成:本番制作前のイメージ共有に最適

- SNS用ショート動画:低コストで量産できる

- プレゼン資料への動画挿入:静止画より訴求力が上がる

- ゲーム・アプリのアセット生成:背景動画やエフェクト素材として活用

注意点と制限事項

- 生成時間:3秒の動画でRTX 4090環境で約2分かかる

- 品質:商用サービス(Sora、Runwayなど)と比べると細部の破綻がある

- 人物生成:顔や手の表現は苦手で、アーティファクトが発生しやすい

- 音声なし:動画のみの生成で、音声は別途必要

「本番クオリティ」を期待するのではなく、「アイデア検証・方向性確認のツール」として位置づけることが重要です。

AI支援ツールの導入については、smart-coding-mcpでAIアシスタントにセマンティックコード検索を追加するで解説しています。AI動画生成スキルを活かして年収アップを目指すならハイクラスエンジニア転職エージェント3社比較、独立して動画AI案件を受けるならフリーランスエージェント5社比較、社内のクリエイティブ業務を効率化する社内SEのキャリアを目指す方は社内SE転職エージェント3社比較ガイドもチェックしてみてください。生成サーバーの自前構築を検討する場合はエンジニア向けXServer用途別比較ガイドも参考になります。

森田さんは「本番クオリティを最初から目指すと挫折するが、関係者の認識合わせ用と割り切って使うのが正解だった。AI動画は完成品ではなく『議論の起点』として最大の価値が出る」と振り返ります。

よくある質問

Q. LTX-2で生成できる動画の長さに上限はありますか?

公式の推奨では3〜5秒程度が安定動作する範囲です。それ以上長い動画も生成可能ですが、フレーム数が増えるほどVRAM使用量と生成時間が指数的に増加し、品質も劣化しやすくなります。長い動画が必要な場合は、複数の短尺動画を生成して編集ツールで連結するアプローチが現実的です。

Q. 商用サービス(Sora・Runway)と比べてどちらを選ぶべきですか?

用途で使い分けが最適解です。本番納品向けの高品質動画は商用サービス、ラフ動画・プロトタイプ・社内検証はLTX-2が有利です。月の生成本数が10本以下なら商用サービスの従量課金、月50本以上ならLTX-2のローカル運用がコスト面で逆転します。

Q. 日本語のプロンプトは使えますか?

学習データの大半が英語のため、英語プロンプトの方が品質は安定します。日本語でも動作はしますが、抽象的な表現や日本特有の概念(「侘び寂び」「セピア調」など)は英語に翻訳してから入力するのがおすすめです。

Q. LTX-2の生成結果に著作権上の注意点はありますか?

LTX-2自体はApache 2.0ライセンスで生成物の権利は使用者に帰属しますが、学習データに含まれる既存IPへの類似性には注意が必要です。プロンプトに既存の作品名・キャラクター名を含めない、生成結果が既存作品と酷似していないか目視確認する、商用利用前に法務確認を入れる、という3点を運用フローに組み込んでください。

Q. AI動画生成スキルをキャリアにどう活かせますか?

PdM・マーケ職では「動画プロトタイピングを自走できる人材」として希少性が増しています。エンジニアなら自社プロダクトの動画自動生成基盤を構築する経験が高く評価されます。社内のクリエイティブ業務効率化を主導するポジションを狙うなら社内SE転職エージェント3社比較ガイドも併せて確認してください。

本記事で解説したようなAI技術を、基礎から体系的に身につけたい方は、以下のスクールも検討してみてください。

| 比較項目 | Winスクール | Aidemy Premium |

|---|---|---|

| 目的・ゴール | 資格取得・スキルアップ初心者〜社会人向け | エンジニア転身・E資格Python/AI開発 |

| 難易度 | 個人レッスン形式 | コード記述あり |

| 補助金・給付金 | 教育訓練給付金対象 | 教育訓練給付金対象 |

| おすすめ度 | 幅広くITスキルを学ぶなら | AIエンジニアになるなら |

| 公式サイト | 詳細を見る | − |

まとめ

LTX-2は、ローカル環境で無料かつ無制限に使えるAI動画生成モデルとして、特にプロトタイプ作成や社内向けコンテンツ制作に大きな可能性を持っています。

- 環境構築:RTX 3090以上のGPUがあれば30分程度でセットアップ可能

- 活用場面:ラフ動画・プロトタイプ・SNSショート動画に最適

- プロンプト設計:具体的なシーン描写・カメラワーク・雰囲気を指定する

- 注意点:本番クオリティではなく検証用途として活用する

商用サービスへの従量課金が負担になっているチームや、アイデア検証を高速に回したいエンジニアにとって、LTX-2は強力な選択肢になります。

まずは小さなプロジェクトで試してみてください。