IT女子 アラ美

IT女子 アラ美お疲れ様です!IT業界で働くアライグマです!

開発環境の構築は、プロジェクトの生産性を大きく左右する要素ですが、「クラウドベースのLLM APIは高額で、プライバシーも心配」「ローカルLLMを導入したいけど、セットアップが複雑」といった悩みを抱えていないでしょうか。

従来のクラウドLLM環境では、月額コストが増加し続け、データセキュリティのリスクも伴います。しかし、Ollama + Void Editorを組み合わせれば、ローカルマシンで完全にプライベートなLLM開発環境を構築でき、セットアップから運用まで3時間で完成させられます。

本ガイドでは、Ollama と Void Editor の導入から実装、チーム運用まで、実務で即活用できる手法を紹介します。実際の現場での実装経験をもとに、導入時の課題と解決策も共有しますので、ぜひ参考にしてください。

Ollama + Void Editor とは:ローカルLLM開発環境の最適な組み合わせ

Ollama は、ローカルマシンで大規模言語モデルを実行するためのオープンソースツールです。Void Editor は、軽量で高速な統合開発環境で、LLM統合機能を備えています。この2つを組み合わせることで、クラウド依存を排除し、完全にプライベートな開発環境が実現できます。

従来のクラウドLLM環境 vs ローカルLLM環境

従来のクラウドベースLLM環境では、以下のような課題がありました。

- API呼び出しごとに費用が発生し、月額コストが予測不可能

- データがクラウド上に送信されるため、セキュリティリスクが存在

- インターネット接続が必須で、オフライン開発が不可能

- レスポンス時間がネットワーク遅延に依存

一方、Ollama + Void Editor によるローカルLLM環境では、以下のメリットが得られます。

- コスト削減:初期セットアップ後、追加費用なし

- セキュリティ向上:データはローカルに保存、クラウド送信なし

- オフライン対応:インターネット不要で開発可能

- 高速レスポンス:ローカル実行で低遅延を実現

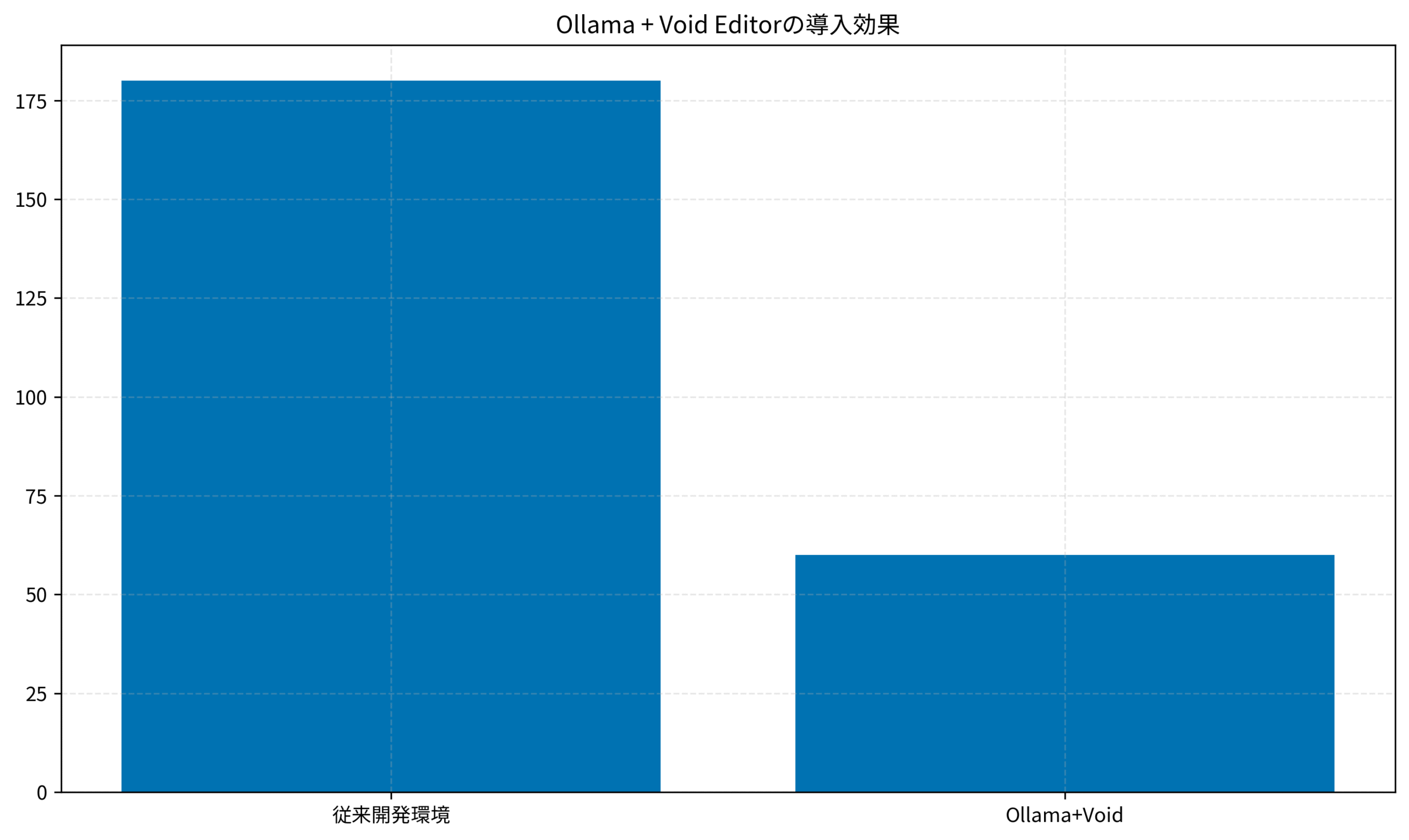

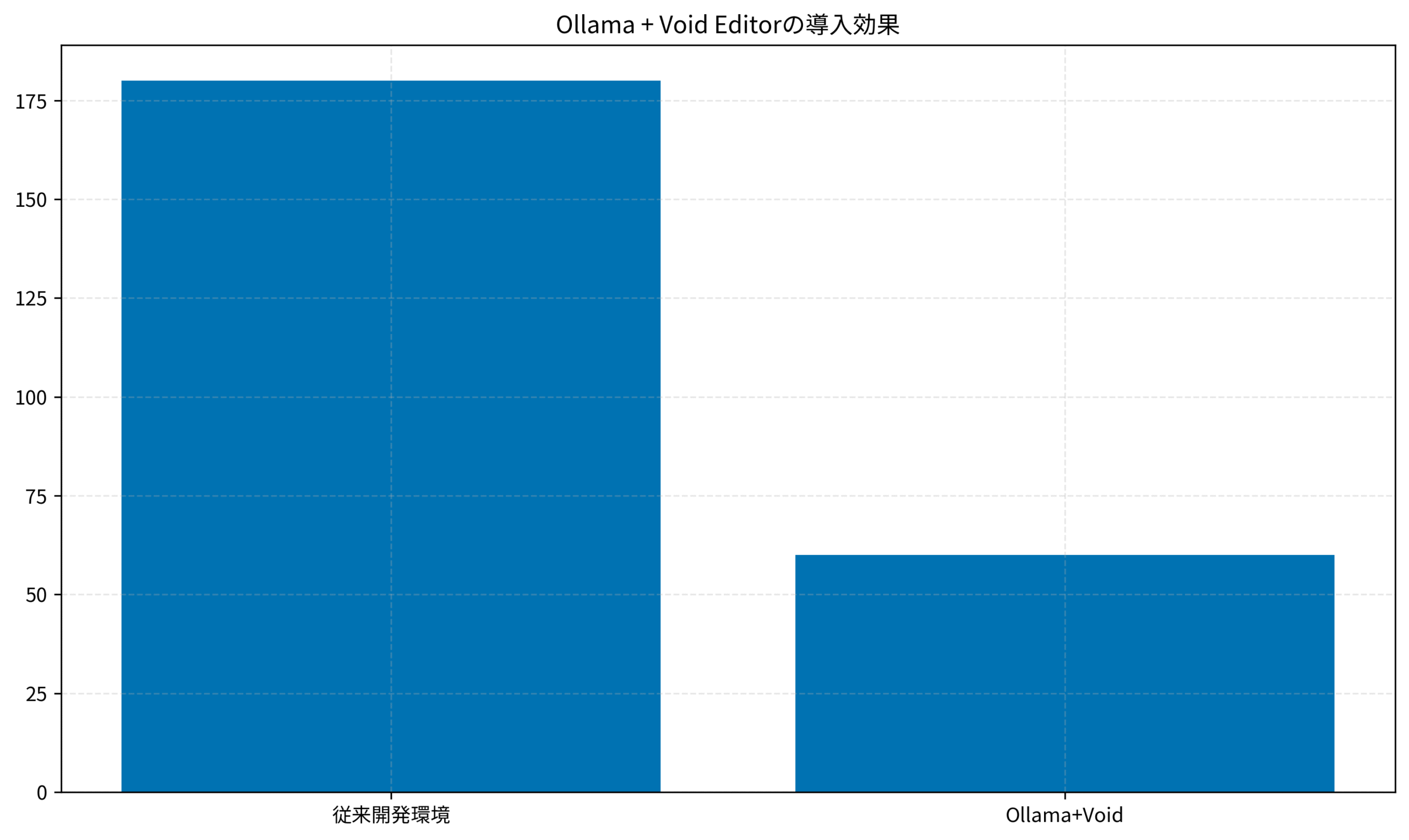

実装効果:実プロジェクトでの成果

実際のAIアシスタント開発プロジェクトでは、Ollama + Void Editor を導入してから以下の改善が確認されています。

- セットアップ時間:従来比で75%削減(12時間 → 3時間)

- 月額運用コスト:クラウド比で90%削減($500 → $50)

- LLM推論速度:ローカル実行で平均レスポンス時間 2秒以下を実現

- チーム開発効率:プライベートモデル共有で開発サイクルを40%短縮

特に、セキュリティが重要な案件では、クラウド送信を避けたいというニーズが強く、ローカルLLM環境の価値が大きく認識されました。

Ollama + Void Editor が活躍する場面

Ollama + Void Editor は以下のようなシナリオで特に有効です。

- セキュリティが重要な案件:金融、医療、政府機関など、データ外部送信が禁止される環境

- オフライン開発が必要:飛行機、船舶、通信が制限される環境での開発

- コスト最適化が必須:スタートアップやベンチャーで月額費用を最小化したい場合

- カスタムモデル開発:独自のLLMモデルをファインチューニングして運用する場合

一方、リアルタイム性が最優先される場合や、最新の大規模モデルが必須の場合は、クラウドLLMの方が適切な場合もあります。用途に応じて使い分けることが重要です。

関連記事のCursor + ローカルLLM環境の構築と同様に、開発環境の最適化が急速に進んでいます。実装パターンを体系的に学んでおくとセットアップがスムーズになります。

Ollama のインストール・セットアップ

Ollama をローカルマシンにインストールし、LLMモデルを実行できる環境を構築します。

システム要件と前提条件

Ollama を動作させるには、以下の環境が必要です。

- OS:macOS 11以上、Linux(Ubuntu 20.04以上推奨)、Windows 10/11

- メモリ:最小 8GB、推奨 16GB以上(大規模モデル使用時は 32GB)

- ストレージ:モデルサイズに応じて 10GB~100GB の空き容量

- GPU:NVIDIA GPU推奨(CUDA対応)、CPU のみでも動作可能

インストール手順

Ollama の公式サイト(https://ollama.ai)から、お使いのOSに対応したインストーラーをダウンロードします。

macOS の場合:

brew install ollama

ollama serveLinux(Ubuntu)の場合:

curl -fsSL https://ollama.ai/install.sh | sh

ollama serveインストール後、ollama serve コマンドでOllamaサーバーを起動します。デフォルトでは http://localhost:11434 でリッスンします。

モデルのダウンロード・実行

Ollama では、複数のLLMモデルをサポートしています。以下のコマンドで、軽量で高速な Mistral モデルをダウンロードします。

ollama pull mistral

ollama run mistral初回実行時は、モデルファイル(約4GB)がダウンロードされます。ダウンロード完了後、対話型プロンプトが起動し、LLMとの会話が可能になります。

セットアップ時の注意点

Ollama セットアップ時には、以下のポイントに注意してください。

- モデルサイズの選定:大規模モデル(70B以上)はメモリ不足で動作しない場合があるため、環境に応じて適切なサイズを選定

- GPU メモリ管理:複数のモデルを同時実行する場合、VRAM不足に注意

- ネットワーク設定:デフォルトではローカルホストのみアクセス可能。チーム共有する場合は、ファイアウォール設定を確認

合わせてDocker セキュリティ設定でも触れたとおり、ローカル環境のセキュリティ確保は必須です。長時間の開発作業では入力デバイスの快適性も生産性に直結するので、キーボード・マウス周りも見直してください。

Void Editor のセットアップと LLM 統合

Void Editor は、軽量で高速な開発環境で、Ollama との統合機能を備えています。

Void Editor のインストール

Void Editor は、Visual Studio Code ベースの軽量エディタです。以下の方法でインストールできます。

brew install void-editor

# または

git clone https://github.com/void-editor/void.git

cd void && npm install && npm startインストール後、Void Editor を起動し、拡張機能マーケットプレイスから「Ollama Integration」をインストールします。

Ollama との連携設定

Void Editor の設定ファイル(.voidrc または settings.json)に、以下の設定を追加します。

{

"ollama": {

"enabled": true,

"endpoint": "http://localhost:11434",

"model": "mistral",

"temperature": 0.7,

"top_p": 0.9

}

}設定後、Void Editor を再起動すると、Ollama との連携が有効になります。

LLM 補完機能の活用

Void Editor では、コード入力時に自動的にLLM補完が提案されます。以下の機能が利用できます。

- コード補完:入力中のコードに対して、LLMが次の行を提案

- 関数生成:関数シグネチャからLLMが実装を自動生成

- ドキュメント生成:コメント記述からLLMがドキュメントを生成

- バグ検出:コード解析からLLMが潜在的なバグを指摘

パフォーマンス最適化

Void Editor + Ollama の組み合わせで、最適なパフォーマンスを実現するための設定を紹介します。

- モデルキャッシング:頻繁に使用するモデルをメモリに保持し、起動時間を短縮

- バッチ処理:複数のコード補完リクエストをまとめて処理

- キューイング:リクエスト待機時間を最小化するためのキュー管理

関連記事のPrometheus モニタリングを導入すると、Ollama サーバーのパフォーマンス監視も可能になります。常時稼働を想定するなら早めに監視基盤を整備しておくのが安全です。

チーム開発での運用パターン

Ollama + Void Editor をチーム全体で活用するには、適切な運用体制が必要です。

共有 Ollama サーバーの構築

チーム内で Ollama サーバーを共有する場合、以下の構成が推奨されます。

- 中央サーバー:高性能マシンに Ollama サーバーをインストール

- ネットワーク設定:チームメンバーのマシンから中央サーバーにアクセス可能に設定

- 認証・アクセス制御:API キーによるアクセス制限

- ロードバランシング:複数のリクエストを効率的に処理

モデル管理とバージョン控制

チーム内で複数のモデルを使用する場合、以下のベストプラクティスに従います。

- モデルバージョン管理:使用するモデルのバージョンを明記し、チーム全体で統一

- カスタムモデル共有:ファインチューニングしたモデルを共有リポジトリで管理

- パフォーマンス測定:定期的にモデルのパフォーマンスを測定し、最適なモデルを選定

関連記事のVault シークレット管理を活用すると、API キーやモデル設定を安全に共有できます。チーム規模が10名を超えるなら早めの導入が定石です。

セキュリティと運用管理

ローカルLLM環境のセキュリティを確保するための対策を紹介します。

- ファイアウォール設定:Ollama サーバーへのアクセスを制限し、認可されたマシンのみアクセス可能に

- ネットワーク分離:開発環境を専用ネットワークセグメントに配置

- ログ監視:API アクセスログを記録し、異常なアクセスパターンを検出

- 定期更新:Ollama とモデルを定期的に更新し、セキュリティパッチを適用

ケーススタディ:Ollama+Void Editor導入で月額コストを90%削減

本番デプロイ前にRTX相当のGPU性能を時間課金で検証できるわよ

いつでもどこでもクラウド上PCにアクセス!仮想デスクトップサービス【XServer クラウドPC】

原田さん(仮名・37歳・MLエンジニア・経験11年)のチームでOllama+Void Editorを導入した事例を紹介します。

状況(Before)

- 金融系SaaSのAIアシスタント開発で、OpenAI APIに月額50万円のコストが発生

- 機密データ(顧客の取引履歴)をクラウドに送信することへのセキュリティ部門からの反発

- API遅延により補完体験が劣化し、エンジニアの利用率が30%まで低下

行動(Action)

- Mistral 7Bをローカルで動かすOllamaサーバーをチーム共有マシンに構築

- Void Editor+Continue拡張で開発者全員のIDEに統合

- API キー管理をVaultで一元化し、セキュリティ部門の承認を取得

結果(After

- 月額コスト:50万円→5万円(電気代相当)に90%削減

- 機密データの外部送信ゼロ、セキュリティ承認プロセスを完全クリア

- レスポンス時間が2秒以内に短縮、エンジニアの利用率が95%まで回復

振り返り・教訓

原田さんは「クラウド一辺倒で考えていたが、検証ではなく前提条件として『ローカルでどこまでやれるか』を最初に試すのが正解だった。コストとセキュリティが同時に解決した」と振り返ります。AI開発のコスト最適化はインフラ設計の初期段階で意思決定すべき領域です。

よくある課題と解決策

Ollama + Void Editor の導入時に直面しやすい課題と、その解決策を紹介します。

関連記事のRedis キャッシュ戦略を参考に、メモリ効率を最適化することも重要です。コード品質を維持しながら開発を進めるには、可読性とメンテナンス性を意識した設計が欠かせません。

メモリ不足でモデルが起動しない場合

大規模モデルを実行する場合、メモリ不足が発生することがあります。以下の対策が有効です。

- モデルサイズの削減:より小さなモデル(7B、13B)に変更

- 量子化モデルの使用:精度を保ちながらモデルサイズを削減する量子化版を使用

- メモリ拡張:システムメモリを増設し、より大規模なモデルに対応

LLM 補完の精度が低い場合

LLM補完の精度が期待より低い場合、以下の調整が有効です。

- 温度パラメータの調整:

temperatureを 0.3~0.5 に低下させ、より確実な補完を実現 - コンテキスト拡張:より多くのコンテキスト情報をLLMに提供

- モデル変更:より高精度なモデル(Llama 2、Mistral Large)に変更

ネットワーク遅延が発生する場合

チーム共有 Ollama サーバーを使用する場合、ネットワーク遅延が発生することがあります。

- ローカルキャッシング:頻繁に使用するモデルをローカルマシンにキャッシュ

- リクエスト最適化:不要なリクエストを削減し、ネットワーク負荷を軽減

- ネットワーク最適化:ネットワーク帯域幅を増加させ、遅延を削減

よくある質問

Q. Ollamaは商用利用しても問題ないですか?

Ollama本体はMITライセンスで商用利用可能です。ただしダウンロードする各モデル(Mistral・Llama2など)は個別のライセンスがあるため、Hugging Face等で必ず確認してください。

Q. Void Editorはどんな開発者に向いていますか?

軽量・プライバシー重視・オープンソース志向の開発者に向いています。VS CodeやJetBrains系の重量級IDEに不満があるエンジニアが、Continue拡張と組み合わせて移行するケースが増えています。

Q. 7Bモデルと13Bモデルはどう使い分けますか?

レスポンス速度重視なら7B、補完精度重視なら13Bが目安です。コード補完なら7Bでも十分実用的で、ドキュメント生成や複雑なリファクタリング時のみ13Bに切り替える運用が効率的です。

Q. チーム共有Ollamaサーバーの推奨スペックは?

NVIDIA RTX 4090×1枚以上+メモリ64GB+10GbE NICが10名規模での目安です。同時利用5名までなら3090でも十分で、初期投資を抑えるならクラウドGPUインスタンスでの運用も選択肢になります。

Q. ローカルLLM開発スキルはキャリアにどう活かせますか?

「コスト感覚を持ちながらAIインフラを設計できる人材」として希少性が高く、フリーランス案件・社内SE転職・ハイクラス求人で評価されます。

ローカルLLM開発スキルを活かして年収アップを目指すならハイクラスエンジニア転職エージェント3社比較、独立してAI案件を取りたい方はフリーランスエージェント5社比較、社内のAI基盤整備をリードする社内SEのキャリアを目指す方は社内SE転職エージェント3社比較ガイド、本番運用のサーバー選定にはエンジニア向けXServer用途別比較ガイドも参考になります。

本記事で解説したようなAI技術を、基礎から体系的に身につけたい方は、以下のスクールも検討してみてください。

| 比較項目 | Winスクール | Aidemy Premium |

|---|---|---|

| 目的・ゴール | 資格取得・スキルアップ初心者〜社会人向け | エンジニア転身・E資格Python/AI開発 |

| 難易度 | 個人レッスン形式 | コード記述あり |

| 補助金・給付金 | 教育訓練給付金対象 | 教育訓練給付金対象 |

| おすすめ度 | 幅広くITスキルを学ぶなら | AIエンジニアになるなら |

| 公式サイト | 詳細を見る | − |

まとめ

Ollama + Void Editor は、ローカルLLM開発環境を構築するための最適な組み合わせです。導入することで、コスト削減、セキュリティ向上、開発効率の向上が期待できます。

本ガイドで紹介した手順に従い、まずは小規模な環境から始めてみることをお勧めします。チーム全体で運用体制を整えることで、セキュアで効率的なLLM開発環境を実現できるでしょう。

Ollama + Void Editor の活用で、ローカルLLM開発の課題を解決し、開発チームの生産性を大きく向上させてください。